Transparència algoritmico: Chatbot con intelligenza artificiale generativa a supporto dei cittadini AOC

Panoramica

Problema che si prevede di risolvere entro la fine del 2023

-

- Necessità di assistenza costante: Gli utenti AOC necessitano di supporto continuo, 24 ore su 7, XNUMX giorni su XNUMX, ma il supporto di persona o telefonico non può garantire questa piena disponibilità.

- Aumento delle richieste e degli incidenti: Il crescente utilizzo dei servizi digitali e del portale transparència L'aumento della domanda di informazioni e assistenza da parte dell'AOC ha portato a un aumento della domanda di informazioni e assistenza, con oltre 91.000 richieste annuali (dati del 2023) gestite dal Centro Servizi per gli Utenti (CAU). Per gestire questo aumento in modo efficiente e mantenere l'impegno del CAU nei confronti dei cittadini, questo è un buon momento per valutare l'integrazione di nuovi strumenti che aiutino a ottimizzare le risorse.

- Divario digitale e difficoltà di ricerca: Molti utenti, colpiti dal digital e social divide, spesso hanno difficoltà a sapere cosa cercare o a interpretare correttamente i risultati dei motori di ricerca tradizionali. Ciò può portare a confusione e frustrazione nella tua esperienza digitale, rendendo necessario un supporto più personalizzato che consenta un facile accesso alle informazioni pertinenti.

Soluzione adottata

-

- Sviluppo di chatbot con intelligenza artificiale generativa: Per facilitare l’auto-risoluzione delle domande in modo accessibile e immediato, sono stati creati assistenti conversazionali basati sull’intelligenza artificiale. Questi chatbot permettono di rispondere alle domande più comuni degli utenti utilizzando grandi quantità di dati e algoritmi che interpretano il linguaggio naturale.

- Perché optare per i chatbot con intelligenza artificiale generativa? L'AOC ha iniziato a sperimentare i chatbot quasi un decennio fa, introducendoli gradualmente per migliorare il supporto agli utenti. Inizialmente, sono stati implementati chatbot convenzionali come Paula (21/01/2021), che ha fornito supporto nel processo di identificazione con VÀLid; Rita (29/04/2021), che ha assistito nell'ottenimento, nell'utilizzo e nel rinnovo delidCAT Certificato e chatbot del portale transparència (19/4/2023), dedicato alla risoluzione di quesiti in questo ambito. Nonostante la loro utilità, questi chatbot operano con regole e flussi strutturati di domande e risposte predefinite, il che richiede un'intensa formazione manuale, rende la loro implementazione complessa e costosa e fornisce risposte con un relativo successo.Vedi il file di transparència Chatbot AOC convenzionali)

Con questa esperienza, l’AOC è ora impegnata in una nuova generazione di chatbot basati su dati e intelligenza artificiale generativa, che necessitano di molta meno formazione e possono fornire risposte più personalizzate e contestualizzate, migliorando così l’esperienza dell’utente. Inoltre, questa tecnologia permette di re-ask, cioè di completare la domanda iniziale mantenendo la coerenza con la conversazione precedente, mentre nei chatbot convenzionali ogni domanda viene trattata come se fosse la prima.

A chi è rivolto?

-

- Cittadini che utilizzano i servizi dell'AOC, per offrire loro un supporto accessibile, veloce e 24 ore su XNUMX.

Casi d'uso

I chatbot con intelligenza artificiale generativa vengono applicati nei seguenti servizi AOC:

-

- VALIDO: assiste il cittadino nelle domande più frequenti durante il processo di identificazione sulla pagina VALid.

- idCat Mobile: aiuta a risolvere i dubbi sull'ottenimento, l'utilizzo e il rinnovo delidCat Telefono.

- idCat certificato: offre supporto per ottenere, utilizzare e rinnovare ilidCat Certificato.

- e-NOTUM: risolve dubbi e fornisce supporto nella gestione delle notifiche elettroniche.

- Representa: aiuta i cittadini e le aziende a risolvere i dubbi sulla representazioni e poteri.

- e.FATTO: fornisce supporto nella predisposizione e gestione delle fatture elettroniche.

Livello di rischio del sistema di intelligenza artificiale (secondo i criteri del Regolamento europeo sull'intelligenza artificiale)

-

- Rischio limitato. Non presenta un rischio significativo di danno per la salute, la sicurezza o i diritti fondamentali delle persone, né influenza in modo sostanziale l'esito del processo decisionale.

stato

-

- Implementato e in uso da maggio 2024, con una media di 11.575 utenti mensili.

Contratto sul livello di servizio

-

- Disponibile 24 ore su 7, 99,8 giorni su XNUMX con un livello di disponibilità del XNUMX%.

Principali vantaggi del servizio

Per i cittadini:

-

- Accesso 24 ore su 7, XNUMX giorni su XNUMX alle informazioni: I cittadini possono ottenere assistenza in qualsiasi momento, senza limiti di tempo, facilitando la risoluzione dei dubbi quando ne hanno bisogno.

- Risposta immediata: I chatbot offrono risposte immediate, evitando i tempi di attesa dei canali tradizionali come il supporto faccia a faccia o telefonico.

- Auto-risoluzione delle domande: Gli utenti possono risolvere i propri problemi in modo autonomo, riducendo la dipendenza dal supporto diretto e migliorando l'esperienza.

- Esperienza utente migliorata: I chatbot con intelligenza artificiale generativa consentono un'interazione più naturale e ravvicinata, facilitando un'autentica "conversazione" con l'utente. Questi chatbot possono adattarsi al modo di esprimersi di ogni persona, permettendogli di specificare o perfezionare la propria domanda utilizzando le proprie parole.

Per l'amministrazione:

-

- Ottimizzazione delle risorse: I chatbot gestiscono query ripetitive, liberando il personale per attività più complesse, migliorando l'efficienza in termini di tempo e risorse.

- Riduzione dei costi: Ogni query risolta dal chatbot ha un costo molto inferiore a quello dell'attenzione umana. Una stima preliminare con dati del 2025 stima il risparmio intorno 96% (costo medio approssimativo di 15 € per la consultazione a cui ha partecipato il personale della CAU vs. 0,60 € tramite chatbot).

Questa cifra è indicativa e verrà confermata quando verrà effettuata un'analisi economica più dettagliata. - Maggiore efficienza: I chatbot gestiscono più query contemporaneamente, evitando colli di bottiglia e migliorando la reattività.

- Meno impegno formativo: I chatbot con intelligenza artificiale generativa richiedono meno configurazione e formazione iniziali, a partire da un modello generale pre-addestrato che si adatta con modifiche minime. Il processo di aggiustamento consiste nel rivedere e correggere le risposte errate rilevate, piuttosto che lavorare in modo esaustivo sulla classificazione e sulla strutturazione delle risposte per ciascuna risposta. intento [1].

- Miglioramento continuo dei servizi: L'analisi della conversazione consente di identificare modelli, migliorare le aree chiave e adattare i servizi alle esigenze degli utenti.

Informazioni di contatto

Amministrazione aperta della Catalogna

Contatta il team per domande

Sottodirezione Strategia e Innovazione

E-mail della squadra

innovacio@aoc.cat

UN MILIONE DI BOT, SL

E-mail del fornitore

info@1millionbot.com

Informazioni più dettagliate sul servizio

Familiarizzare con i dati e le informazioni utilizzate dal sistema, la logica di funzionamento degli algoritmi e la sua governance.

Set di dati

La base di conoscenza dei chatbot si basa su tre fonti principali:

-

- Domande frequenti (FAQ): Inizialmente, i chatbot vengono addestrati con un database di domande frequenti disponibile sul portale di supporto. Queste FAQ raccolgono le domande più comuni dei cittadini e vengono aggiornate con le informazioni più recenti sul servizio.

- Biglietti ricorrenti: I chatbot apprendono anche dall'analisi dei ticket di supporto storici, che contengono informazioni sulle domande, i dubbi e gli incidenti degli utenti e su come sono stati risolti.

- Feedback continuo: Il sistema chatbot presenta una forma di apprendimento costante in cui ogni tentativo generativo è corredato da una serie di frasi di addestramento alimentate dalle conversazioni degli utenti. Se una persona pone una nuova domanda, il chatbot proverà a cercare somiglianze nella sua base di frasi di addestramento esistente. Se il chatbot genera una risposta errata a questa domanda, durante il periodo di revisione della conversazione, la frase verrà inclusa nel tentativo corrispondente e l'IA genererà delle varianti di queste per avere una base di conoscenza più ampia.

Altri dati di input:

-

- Dati utente: Per addestrare il modello non vengono utilizzati dati personali degli utenti.

Considerazioni sull elaborazione e conservazione dei dati

-

- Il sistema AI registra in un file le domande poste e le risposte fornite durante la sessione di chat. Genera inoltre report con dati di utilizzo, conversazioni e statistiche online per l'analisi e il miglioramento del servizio.

- Le conversazioni vengono conservate per un massimo di 3 mesi, dopodiché vengono automaticamente cancellate.

- I report sull'utilizzo, inclusi parametri quali l'utilizzo e i tassi di risposta, vengono conservati a tempo indeterminato per garantire la tracciabilità e la valutazione continua del servizio.

Elaborazione dati

La logica operativa del trattamento automatico dei dati e il ragionamento effettuato dal sistema si basa sul seguente modello e metodologia:

Processo di interazione utente-chatbot

Il processo di interazione utente-chatbot avviene attraverso un'interfaccia digitale accessibile da dispositivi quali web, mobile o tablet. L'utente inserisce una domanda in formato testo ("prompt") che descrive le informazioni che desidera ottenere. Il chatbot elabora queste informazioni e genera una risposta testuale per fornire le informazioni richieste.

Architettura del servizio

Il servizio utilizza a motore di intelligenza artificiale generativa [2] che elabora il linguaggio naturale.

-

- Il motore AI utilizzato dal chatbot AOC è GPT-4o, dalla società OpenAI.

- Viene utilizzata un'istanza di Azure OpenAI situata in Europa.

- Il motore funziona sulla base di un grande modello linguistico (Large Language Model, LLM), costituito da reti neurali profonde addestrate con enormi set di dati estratti principalmente da Internet (pagine web, blog, social network, articoli di scienziati, libri , ecc.)

Il servizio è stato adattato da 1MillionBot, che si è occupato di:

-

- Progetta le istruzioni che consentono al modello AI di guidare e seguire le indicazioni.

- Preparare dataset, raccolta e pulizia dei dati che serviranno da riferimento per il sistema Retrieval Augmented Generation (RAG)

- Incorporazione di set di dati nel sistema RAG di 1MillionBot, che è in grado di migliorare la qualità delle risposte utilizzando contesti specifici.

- Testa i casi e convalida la capacità del sistema di gestire errori e query complesse.

- Ottimizzazione del modello in base alle interazioni dell'utente.

L'intera infrastruttura del servizio è ospitata nel cloud di Google Cloud Platform (GCP), in particolare nel data center di Google Cloud in Belgio, all'interno dello Spazio Economico Europeo (SEE). Questa posizione garantisce il rispetto delle normative europee sulla privacy e sulla sicurezza.

Il chatbot dispone di un sistema per raccogliere le opinioni degli utenti e poter valutare la soddisfazione della conversazione complessiva.

Principali caratteristiche dell'architettura:

-

- Alloggi sicuri e certificati:

-

- Le installazioni GCP sono conformi agli standard di sicurezza ISO 27001 i SOC2/3, garantendo un'infrastruttura solida e affidabile.

- Tutta l'infrastruttura del fornitore, 1 milione di bot, inclusa la webchat, la piattaforma Millie (frontend) e la logica e i dati (backend), sono ospitati in questo ambiente.

-

- Isolamento per casi d'uso:

-

- Ogni caso d'uso del servizio è isolato in una rete specifica e in un ambiente di sviluppo, evitando interferenze tra le applicazioni e massimizzando la sicurezza.

-

- Deposito protetto:

-

- Le domande e le risposte alle conversazioni vengono archiviate in database ospitati su macchine virtuali Google Cloud, protette da firewall avanzati e meccanismi di isolamento.

- L'accesso a questi dati avviene esclusivamente attraverso il backend, garantendo un controllo rigoroso.

-

- Protezione contro gli attacchi:

-

- Il sistema incorpora diversi livelli di sicurezza, come ad esempio:

-

- Richiedi limitatori per evitare sovraccarichi.

- Convalide rigorose dei dati e dell'accesso.

- Firewall specializzati per proteggere l’infrastruttura.

-

- Il sistema incorpora diversi livelli di sicurezza, come ad esempio:

-

- Alloggi sicuri e certificati:

Questa architettura garantisce la robustezza, la sicurezza e l'adattabilità necessarie per offrire un servizio di qualità agli utenti.

Prestazioni dell'algoritmo

Tasso di successo dell'91,33%. Questa tariffa viene rivista mensilmente (ultima revisione: 15/04/2025)

Supervisione umana

Il sistema algoritmico del chatbot agisce direttamente, ma è sotto sorveglianza ex post del personale responsabile della decisione finale, intensificato soprattutto nel periodo iniziale di funzionamento per compensare i bias dell’algoritmo e ridurre le risposte errate. Le risposte di Chatbot sono fisse e non possono essere modificate.

La supervisione umana dei chatbot garantisce la qualità e l'accuratezza delle risposte attraverso un processo rigoroso e regolare:

-

- Recensioni settimanali: gli esperti esaminano i registri delle chat per identificare le risposte errate. Per ogni errore rilevato viene annotata la risposta ideale e vengono riclassificate le frasi dell'utente con la risposta sbagliata, assegnandole al tentativo generativo più appropriato.

- Analisi mensile: Vengono valutate 150 conversazioni selezionate casualmente, insieme a quelle già identificate come errate, per individuare modelli di errore e correggere risposte inappropriate.

- Gestione dei tentativi: Quando gli errori non possono essere corretti semplicemente riclassificando le frasi, gli esperti adattano le istruzioni dei tentativi esistenti o ne creano di nuovi.

Questo processo combina la metodologia tradizionale dei chatbot con la flessibilità dell'intelligenza artificiale generativa, garantendo una gestione agile e un servizio affidabile e allineato alle esigenze degli utenti.

Conformità normativa del sistema

Il sistema non tratta dati personali. Nonostante ciò, il sistema è conforme alle normative vigenti in materia di protezione e sicurezza dei dati. In particolare:

-

- Si applicano i principi del Regolamento generale sulla protezione dei dati (RGPD):

- Principio di minimizzazione dei dati: vengono raccolti solo i dati necessari per soddisfare lo scopo del sistema.

-

- Principio di limitazione della finalità: i dati raccolti vengono utilizzati esclusivamente per lo scopo comunicato all'interessato.eressada.

- Si applicano i principi del Regolamento generale sulla protezione dei dati (RGPD):

-

- Da un punto di vista tecnico, la soluzione è conforme ai requisiti stabiliti dal National Security Scheme (ENS) per i sistemi di livello BASSO.

✨Applicazione volontaria di Regolamento dell'Unione Europea sull'intelligenza artificiale (regolamento AI) [3]

Il sistema è conforme ai requisiti del Regolamento AI richiesti in caso di sistemi di intelligenza artificiale a rischio limitato i modelli di intelligenza artificiale generativa senza rischio sistemico. Ecco perché:

-

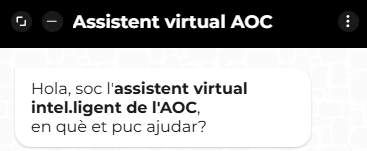

- Gli utenti vengono informati fin dall'inizio che stanno interagendo con un'intelligenza artificiale. Per questo motivo il servizio si presenta come “assistente virtuale AOC” e non con un nome personale.

-

- Come IA generativa, I chatbot AOC soddisfano inoltre i seguenti requisiti:

-

- È stato rivelato che il contenuto è generato dall'intelligenza artificiale.

- Viene pubblicato un riepilogo dei dati di addestramento.

- Le informazioni sul modello AI sono fornite in un linguaggio chiaro e accessibile.

Gli ultimi due punti sono soddisfatti con questa scheda tecnica. transparència algoritmico.

-

- Questi chatbot non sono soggetti ai requisiti per l’IA generativa con rischio sistemico. Ciò significa che non è necessario superare valutazioni di modelli o test contraddittori, né riferire sull’efficienza energetica.

- Come IA generativa, I chatbot AOC soddisfano inoltre i seguenti requisiti:

È un Azione amministrativa automatizzata (AAA)? No.

In questo caso l'AOC non è soggetto all'obbligo legale di pubblicare sul proprio sito web l'AAA collegato al servizio, accompagnato da una scheda tecnica (Cfr. articolo 11, lettera i, del Regio Decreto 203/2021, che approva il Regolamento sulla prestazioni e funzionamento del settore pubblico con mezzi elettronici, che attua la legge 40/2015 sul regime giuridico del settore pubblico)

Gestione del rischio

Conosci il rischi più probabili in relazione al principi e diritti fondamentali che devono essere protetti e le misure applicate in ciascun caso per mitigarli o minimizzarli.

A. Uguaglianza e non discriminazione

-

- Rischi identificati: distorsioni nei risultati, rischio di esclusione e discriminazione.

-

- Il modello LLM del motore GPT-4o, che costituisce la base dei chatbot AOC, è preaddestrato con grandi quantità di dati provenienti da Internet. Questi dati includono un’ampia varietà di informazioni e possono contenere pregiudizi legati al genere, all’origine etnica, alla lingua, tra gli altri. Di conseguenza, il sistema può riprodurre modelli discriminativi presenti nei dati di addestramento. Inoltre, la complessità delle reti neurali rende difficile identificare e prevenire questi pregiudizi.

- D’altra parte, il catalano non è una delle principali lingue utilizzate nella formazione dei modelli. Ciò può comportare risposte con un uso predominante di forme maschili e una minore diversità linguistica, influenzando l’inclusività e la ricchezza delle interazioni in quella lingua.

-

- Misure applicate

-

- Dati di formazione representative: I dati utilizzati per eseguire la formazione finale e adattare il chatbot sono stati attentamente selezionati per includere gruppi di popolazione diversi ed evitare distorsioni esplicite al fine di garantire che le risposte siano le più representapossibile ed equo.

- Uguaglianza nell'accesso linguistico: Il servizio può essere utilizzato in catalano e spagnolo, con la possibilità di scegliere la lingua all'inizio della conversazione o cambiarla durante l'utilizzo. Ciò consente a tutti gli utenti di interagire con il sistema nella lingua che preferiscono.

-

- Attualmente il chatbot chiede all'utente in quale lingua preferisce essere servito, poiché ciò migliora la precisione delle risposte. Tuttavia, vengono condotti test per valutarne le prestazioni senza la necessità di chiedere la lingua.

-

- Interpretazione tollerante del linguaggio: Il sistema è progettato per comprendere il linguaggio naturale, anche se sono presenti errori di ortografia o linguistici, garantendo che gli utenti non vengano penalizzati per piccoli errori nelle loro query.

- Inclusione e diversità nel design: È stato lavorato su un'interfaccia chatbot che chiunque può utilizzare facilmente, indipendentemente dal proprio livello di competenza digitale, per garantire che tutti possano accedere al servizio senza barriere.eres tecnologico.

-

- Rischi identificati: distorsioni nei risultati, rischio di esclusione e discriminazione.

B. Protezione dei dati, privacy e libertà di scelta

-

- Rischi identificati: possibile minaccia alla privacy, uso improprio dei dati personali da parte di terzi e perdita della libertà di scelta.

-

- Il servizio non richiede mai informazioni di identificazione personale. Il servizio comporta tuttavia un rischio legato al trattamento dei dati personali qualora l'utente inserisca dati personali non necessari.

-

- Misure applicate

-

- Per proteggere i dati e la privacy:

-

- Il fornitore (1MillionBot) ha firmato un Ordine di Elaborazione con l'ubicazione dei dati all'interno dell'Unione Europea.

- Il Titolare del trattamento (AOC) garantisce i diritti ARCO (Accesso, Rettifica, Cancellazione e Opposizione) dei dati trattati.

- Consenso e cookie sono gestiti.

- I registri delle conversazioni vengono regolarmente esaminati da esperti che rimuovono tutti i dati personali non rilevati dal sistema.

- Nella prossima versione verrà implementata una funzionalità che cancellerà automaticamente qualsiasi numero di previdenza sociale o email inserita nella chat e l'utente potrà richiedere che la propria conversazione venga rimossa dal sistema.

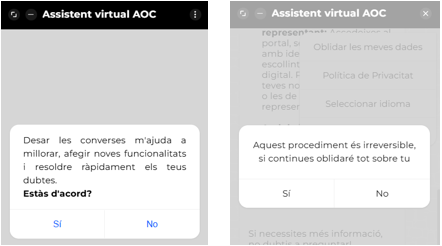

- L'utente viene informato che la conversazione verrà salvata. Se non sei d'accordo non puoi continuare.

- L'utente può eliminare le conversazioni.

-

- Per garantire la libertà di scelta:

-

- Offriamo alternative per aiutare i cittadini senza l’uso di algoritmi di intelligenza artificiale, come il supporto telefonico ed e-mail. Se l'utente chiede specificamente di "contattare l'assistenza", "parlare con un agente", "Voglio più supporto" o simili, il bot reindirizza automaticamente alle pagine di contatto dell'assistenza AOC. Inoltre, il chatbot si trova all'interno degli stessi portali di supporto AOC, dove puoi anche accedere direttamente all'opzione "Contatta l'assistenza" dal piè di pagina.

-

- Per proteggere i dati e la privacy:

-

- Rischi identificati: possibile minaccia alla privacy, uso improprio dei dati personali da parte di terzi e perdita della libertà di scelta.

C. Sicurezza e robustezza

-

- Rischi identificati: diffusione di informazioni errate, errori e incoerenze nelle risposte, indisponibilità del servizio e accesso non autorizzato ai dati.

-

- Modelli basati su reti neurali e calcoli probabilistici rendono difficile interpretare come viene raggiunto il risultato finale, il che limita il controllo sulle risposte generate. Inoltre, la natura dell’intelligenza artificiale generativa può occasionalmente far sì che il sistema tragga informazioni oltre la sua specifica base di conoscenza, inclusi fonti o dati esterni non verificati, il che potrebbe portare a risposte fuori contesto o su argomenti che non appartengono al loro campo .

- Per mitigare questi rischi, il motore AI deve essere installato in un ambiente controllato e protetto, con configurazione e sicurezza rigorose per garantire protezione e integrità del servizio.

-

- Misure applicate

-

- Il sistema è stato installato in un ambiente chiuso e sicuro, basato su un'architettura certificata (vedi caratteristiche principali dell'architettura). Questa configurazione garantisce:

- Robustezza e affidabilità, garantendo il corretto funzionamento del sistema.

- Sicurezza e riservatezza dei dati gestiti.

-

- Adattabilità, per offrire risposte di qualità in linea con le esigenze degli utenti.

- Analisi dei rischi per la sicurezza: l'AOC ha effettuato una valutazione della sicurezza seguendo le linee guida dell'Agenzia Catalana per la Sicurezza Informatica e del Sistema Nazionale di Sicurezza (ENS). Il sistema è stato classificato con un livello di sicurezza BASSO e, in base a questa categorizzazione, sono state implementate misure specifiche per mitigare i rischi identificati. In particolare, per garantire la disponibilità e corretto funzionamento del sistema:

- Con il fornitore sono stati stabiliti accordi sul livello di servizio (SLA), che devono essere rispettati e rivisti periodicamente, per garantire la capacità, la disponibilità e la gestione degli incidenti del sistema.

-

- Ogni due settimane vengono redatti rapporti di conformità ANS per garantire che il servizio mantenga gli standard concordati.

- Il sistema è stato installato in un ambiente chiuso e sicuro, basato su un'architettura certificata (vedi caratteristiche principali dell'architettura). Questa configurazione garantisce:

-

- Per garantire il diritto all'a informazioni veritiere e adeguate: vengono applicati protocolli per rivedere il sistema, minimizzando errori e incoerenze e migliorando la qualità delle risposte. Inoltre, per garantire risposte nell'ambito di competenza del chatbot:

-

- Sono stati implementati filtri per parole chiave e argomenti (es. Certificato di iscrizione, Pagamento di una multa, Preiscrizione a scuola, ecc.). Questi filtri generano "tentativi fuori catalogo", con i quali il chatbot informa di non avere informazioni sull'argomento e consiglia di rivolgersi all'amministrazione competente.

- Il modello viene addestrato esclusivamente sui dati del dominio AOC, garantendo il più possibile che le informazioni siano pertinenti e adatte allo scopo.

-

- Per garantire il diritto all'a informazioni veritiere e adeguate: vengono applicati protocolli per rivedere il sistema, minimizzando errori e incoerenze e migliorando la qualità delle risposte. Inoltre, per garantire risposte nell'ambito di competenza del chatbot:

-

- Rischi identificati: diffusione di informazioni errate, errori e incoerenze nelle risposte, indisponibilità del servizio e accesso non autorizzato ai dati.

D. Transparència e spiegabilità

-

- Rischi identificati: diffidenza, errata interpretazione dei risultati da parte degli utenti (incapacità di comprendere il risultato), confusione nel pensare che si tratti di un'interazione con un essere umano, difficoltà nel presentare reclami o richieste sui risultati ottenuti

- Misure applicate

-

- Chiara identificazione come AI: Fin dall'inizio il servizio si presenta come un "assistente virtuale" per evitare confusione sulla natura dell'interazione.

-

- Consenso dell'utente: Gli utenti vengono informati che la conversazione verrà salvata, in modo che possano decidere se continuare.

- Archivio di transparència algoritmico: È pubblicato sul sito web dell'AOC, con informazioni su:

-

- Problema da risolvere

- Con il sistema AI implementato

- Destinatari

- Dati utilizzati per addestrare il sistema AI

- Identità e dati di contatto del fornitore

- Organismo responsabile e indirizzo di contatto per reclami, richieste e suggerimenti

-

- Facile accesso al file: Il foglio di transparència È consultabile dalla home page del servizio.

-

E. Tenuta dei conti e verificabilità

-

- Rischi identificati: Limitazioni nella tracciabilità dei risultati, mancanza di verifica e riesame periodici, difficoltà di interpretazione del modello anche da parte di specialisti, assenza di responsabilità assegnata.

-

- I rischi associati alla responsabilità e alla verificabilità dei chatbot con intelligenza artificiale generativa possono mettere a repentaglio l’affidabilità del sistema se non vi sono mezzi per tracciare accuratamente il processo di generazione della risposta, verificarne la qualità su base regolare e garantire che l’operazione sia comprensibile anche dagli specialisti. Questi fattori rendono difficile un’adeguata supervisione del servizio e rendono difficile attribuire la responsabilità di errori o decisioni ingiuste, che possono incidere sulla fiducia nel servizio pubblico.

-

- Misure applicate

-

- Per garantire la responsabilità del sistema di IA e dei suoi risultati:

-

- Monitoraggio della qualità e dell'impatto: Vengono realizzati report bisettimanali con indicatori di qualità e di impatto per valutare se il servizio soddisfa gli obiettivi stabiliti.

-

- Per garantire la responsabilità del sistema e dei suoi risultati:

- Viene informato chi è responsabile del servizio (COA) e la procedura da seguire per presentare un reclamo in caso di impatti negativi.

- Per garantire la verificabilità:

-

- L'AOC si riserva il diritto di condurre ulteriori audit per rivedere gli indicatori di qualità e gli accordi sul livello di servizio (SLA) in qualsiasi momento, garantendo così un monitoraggio continuo dell'affidabilità del sistema.

-

- Per garantire la responsabilità del sistema di IA e dei suoi risultati:

-

- Rischi identificati: Limitazioni nella tracciabilità dei risultati, mancanza di verifica e riesame periodici, difficoltà di interpretazione del modello anche da parte di specialisti, assenza di responsabilità assegnata.

F. Sviluppo sostenibile e solidarietà

-

- Rischi identificati: impatto ambientale negativo, disuguaglianze nell'accesso a questa tecnologia a causa del suo elevato costo.

-

- L'uso di chatbot con intelligenza artificiale generativa pone sfide significative in termini di sostenibilità ed equità. Da un lato, il suo impatto ambientale è elevato, poiché richiede grandi risorse di calcolo per l'elaborazione e l'archiviazione dei dati, il che implica un elevato consumo di energia ed emissioni di CO₂. D'altro canto, i costi di implementazione e manutenzione sono significativi, il che può limitare l'accesso a questa tecnologia alle organizzazioni con maggiori risorse.

-

- Misure applicate

-

- Ottimizzazione e messa a punto della formazione del chatbot per ottenere la massima efficienza. Gli studi indicano che una query ChatGPT può equivalere a dieci ricerche su Google; pertanto, se ciò fosse confermato, l’elevato costo energetico dell’IA generativa potrebbe essere compensato dalla sua maggiore efficacia rispetto a metodi più economici.

- Promozione di transparència sui costi di utilizzo contribuire ad un uso più responsabile di questa tecnologia.

-

- Promuovere la trasferibilità: L'AOC sta lavorando per offrire il chatbot come servizio "chiavi in mano" alle amministrazioni locali catalane, facilitando l'accesso a questa tecnologia in modo equo. Questa strategia di replicabilità consentirà l'adozione di un'intelligenza artificiale generativa avanzata senza richiedere grandi investimenti.

-

- Rischi identificati: impatto ambientale negativo, disuguaglianze nell'accesso a questa tecnologia a causa del suo elevato costo.

Maggiori informazioni

-

- Archivio del Registro dell'IA e di altri algoritmi della Generalitat: Chatbot AOC

- Scheda di innovazione AOC: Chatbot con intelligenza artificiale generativa di AOC: attenzione immediata, efficiente e accessibile

- Articolo "IA generativa e ChatGPT. Impatto sull'apprendimento universitario". Di Climent Nadeu Camprubí. Dipartimento di Teoria dei Segnali e delle Comunicazioni (TSC). Centri di ricerca TALP e IDEAI. Università Politecnica della Catalogna (UPC).

[1] Un intento si riferisce all'intenzione o allo scopo che l'utente ha quando pone una domanda o pone una domanda al chatbot. I tentativi aiutano a identificare ciò che la persona desidera ottenere, come ottenere informazioni specifiche, risolvere un problema o completare una procedura. Nei chatbot tradizionali, i tentativi devono essere predefiniti e addestrati manualmente in modo che il chatbot possa riconoscerli e fornire la risposta appropriata. Al contrario, i chatbot con intelligenza artificiale generativa possono identificare e interpretare i tentativi in modo più flessibile generando risposte in tempo reale dal contesto della conversazione, senza la necessità di una classificazione esaustiva dei tentativi in anticipo. Ciò rende l'interazione più naturale e adattata alle esigenze dell'utente.

[2] Alcune delle principali funzionalità di motore di intelligenza artificiale generativa sono:

-

- Identificare e correggere errori tipografici e di ortografia per migliorare la comunicazione.

- Rileva l'intento del messaggio, anche con frasi ambigue o significati multipli.

- Mantiene la memoria a breve termine per collegare le domande e garantire risposte coerenti.

- Valuta le possibili risposte, sceglie la migliore e offre suggerimenti per conversazioni più chiare.

- Si adatta a diverse lingue (catalano, spagnolo, inglese), riconosce lo slang e gli emoji.

[3] El Regolamento del Parlamento europeo e del Consiglio che stabilisce norme armonizzate sull'intelligenza artificiale e che modifica alcuni atti legislativi dell'Unione (noto anche come RIA o AI Act) è entrato in vigore il 2 agosto 2024 e si applicherà a partire dal 2 agosto 2026.