Transparència algorítmica: Chatbots con IA generativa de apoyo a la ciudadanía de la AOC

Visión general

Problemática que se quiere resolver a finales de 2023

-

- Necesidad de asistencia constante: Los usuarios de la AOC necesitan soporte continuo, 24/7, pero la atención presencial o telefónica no puede garantizar esa disponibilidad total.

- Aumento de las consultas e incidencias: El uso creciente de los servicios digitales y del portal de transparència de la AOC ha incrementado la demanda de información y asistencia, con más de 91.000 peticiones anuales (datos 2023) atendidas por el Centro de Atención de Usuarios (CAU). Para gestionar este incremento de forma eficiente y mantener el compromiso del CAU con la ciudadanía, éste es un momento propicio para considerar la incorporación de nuevas herramientas que ayuden a optimizar los recursos.

- Brecha digital y dificultades de búsqueda: Muchos usuarios, afectados por la brecha digital y social, a menudo tienen dificultades para saber qué buscar o interpretar correctamente los resultados de los buscadores tradicionales. Esto puede generar confusión y frustración en su experiencia digital, haciendo necesario un soporte más adaptado que permita acceder fácilmente a la información relevante.

Solución adoptada

-

- Desarrollo de chatbots con IA generativa: Para facilitar la autorresolución de las consultas de forma accesible e inmediata, se han creado asistentes conversacionales basados en IA. Estos chatbots permiten responder a las preguntas más habituales de los usuarios mediante el uso de grandes cantidades de datos y algoritmos que interpretan el lenguaje natural.

- ¿Por qué optar por chatbots con IA generativa? La AOC empezó a experimentar con chatbots hace casi una década, introduciéndolos de forma progresiva para mejorar la asistencia a los usuarios. Inicialmente, se implementaron chatbots convencionales como Paula (21/01/2021), que apoyaba en el proceso de identificación con VÀLid; Rita (29/04/2021), que ayudaba en la obtención, uso y renovación delidCAT Certificado, y el chatbot del portal de transparència (19/4/2023), dedicado a resolver consultas en este ámbito. A pesar de su utilidad, estos chatbots funcionan con reglas y flujos estructurados de preguntas y respuestas predefinidas, lo que requiere un entrenamiento manual intensivo, lo que hace que su implementación sea compleja y costosa y, además, ofrece respuestas con un éxito relativo. (Véase ficha de transparència Chatbots convencionales de la AOC)

Con esta experiencia, AOC apuesta ahora por una nueva generación de chatbots basados en datos e IA generativa, que necesitan mucho menos entrenamiento y pueden ofrecer respuestas más adaptadas y contextualizadas, mejorando así la experiencia de los usuarios. Además, esta tecnología permite repreguntar, es decir, completar la pregunta inicial manteniendo la coherencia previa conversación, mientras que en los chatbots convencionales, cada pregunta se trata como si fuera la primera.

A quién va dirigida

-

- Ciudadanos que utilizan los servicios de la AOC, para ofrecerles soporte accesible, rápido y disponible las 24 horas.

Casos de uso

Los chatbots con IA generativa se aplican en los siguientes servicios de la AOC:

-

- Válido: asiste a la ciudadanía en las consultas más frecuentes durante el proceso de identificación en la página de VALid.

- idCat móvil: ayuda a resolver dudas sobre obtención, uso y renovación delidCat Móvil.

- idCat Certificado: ofrece soporte con la obtención, uso y renovación delidCat Certificado.

- e-NOTUM: resuelve dudas y apoya en la gestión de notificaciones electrónicas.

- Representa: ayuda a la ciudadanía y empresas a resolver las dudas sobre las representaciones y apoderamientos.

- e.FACT: apoya en la elaboración y gestión de las facturas electrónicas.

Nivel de riesgo del sistema de IA (según los criterios del Reglamento europeo de IA)

-

- Riesgo limitado. No plantea un riesgo importante de causar un perjuicio a la salud, seguridad o derechos fundamentales de las personas físicas, ni influye sustancialmente en el resultado de la toma de decisiones.

Estado

-

- Implementado y en uso desde mayo de 2024, con una media de 11.575 usuarios mensuales.

Nivel de acuerdo de servicio

-

- Disponible 24×7 con un nivel de disponibilidad de 99,8%.

Principales beneficios del servicio

Para la ciudadanía:

-

- Acceso 24/7 a la información: Los ciudadanos pueden obtener asistencia en cualquier momento, sin restricciones de horario, facilitando la resolución de dudas cuando lo necesiten.

- Respuesta inmediata: Los chatbots ofrecen respuestas instantáneas, evitando los tiempos de espera de canales tradicionales como el soporte presencial o telefónico.

- Autorresolución de consultas: Los usuarios pueden resolver sus cuestiones de forma autónoma, reduciendo su dependencia de la atención directa y mejorando la experiencia.

- Mejora de la experiencia de los usuarios: Los chatbots con IA generativa permiten una interacción más natural y cercana, facilitando una auténtica "conversación" con la persona usuaria. Estos chatbots pueden adaptarse a la forma de expresarse de cada persona, permitiendo que ésta concrete o afine su pregunta utilizando sus propias palabras.

Para la administración:

-

- Optimización de recursos: Los chatbots gestionan las consultas repetitivas, liberando al personal para tareas más complejas, lo que mejora la eficiencia del tiempo y de los recursos.

- Reducción de costes: Cada consulta resuelta por el chatbot tiene un coste muy inferior al de la atención humana. Una estimación preliminar con datos de 2025 sitúa el ahorro en torno al 96% (coste medio aproximado de € 15 por consulta atendida por personal del CAU vs. € 0,60 vía chatbot).

Esta cifra es orientativa y quedará confirmada cuando se lleve a cabo un análisis económico más detallado. - Aumento de la eficiencia: Los chatbots atienden múltiples consultas a la vez, evitando cuellos de botella y mejorando la capacidad de respuesta.

- Menor esfuerzo de entrenamiento: Los chatbots con IA generativa requieren menos configuración y entrenamiento inicial, partiendo de un modelo general pre-entrenado que se ajusta con correcciones mínimas. El proceso de ajuste consiste en revisar y corregir las respuestas incorrectas detectadas, en lugar de trabajar exhaustivamente en la clasificación y estructuración de las respuestas para cada intención [ 1 ].

- Mejora continua de los servicios: El análisis de conversaciones permite identificar patrones, mejorar áreas clave y adaptar los servicios a las necesidades de los usuarios.

Información de contacto

Administración Abierta de Cataluña

Equipo de contacto para consultas

Subdirección de Estrategia e Innovación

Correo del equipo

innovacio@aoc.cat

ONE MILLION BOT, SL

Correo-e del proveedor

info@1millionbot.com

Información más detallada sobre el servicio

Familiarízate con los datos y la información que utiliza el sistema, la lógica de funcionamiento de los algoritmos y su gobernanza.

Conjuntos de datos

El conocimiento base de los chatbots se fundamenta en tres fuentes principales:

-

- Preguntas frecuentes (FAQs): los chatbots se entrenan inicialmente con una base de datos de preguntas frecuentes disponibles en el portal de soporte. Estas FAQs recogen las consultas más habituales de los ciudadanos y están actualizadas con la más reciente información del servicio.

- Tickets recurrentes: los chatbots también aprenden a partir del análisis de tickets históricos de soporte que contienen información sobre las cuestiones, dudas e incidencias de los usuarios y cómo se han resuelto.

- Retroalimentación continua: el sistema de los chatbots presenta una forma de aprendizaje constante en la que cada intento generativo tiene una serie de frases de entrenamiento nutridas a través de las conversaciones de los usuarios. En caso de que una persona formule una nueva pregunta, el chatbot intentará buscar las similitudes en su base de frases de entrenamiento ya existente. Si el chatbot genera una respuesta incorrecta a esta pregunta, en el período de revisión de conversaciones, se incluirá la frase dentro del intento correspondiente y la IA generará variaciones de éstas para tener una base de conocimiento más extensa.

Otros datos de entrada:

-

- Datos de los usuarios: no se utilizan datos personales de los usuarios para entrenar el modelo.

Consideraciones sobre el tratamiento y la conservación de los datos

-

- El sistema de IA registra en un archivo las preguntas formuladas y las respuestas proporcionadas durante la sesión de chat. También genera informes con datos de uso, conversaciones y estadísticas online para el análisis y la mejora del servicio.

- Las conversaciones se conservan durante un máximo de 3 meses, después de los cuales se eliminan automáticamente.

- Los informes de uso, que incluyen parámetros como tasas de uso y respuesta, se mantienen indefinidamente para garantizar la trazabilidad y la evaluación continua del servicio.

Procesamiento de los datos

La lógica operativa del procesamiento automático de datos y el razonamiento realizado por el sistema se sustenta conforme al siguiente modelo y metodología:

Proceso de interacción usuarios-chatbot

El proceso de interacción usuarios-chatbot se realiza a través de una interfaz digital accesible desde dispositivos como web, móvil o tableta. La persona usuaria introduce una pregunta en formato texto (“prompt”) que describe la información que desea obtener. El chatbot procesa esta información y genera una respuesta en texto para proporcionar la información solicitada.

Arquitectura del servicio

El servicio utiliza un motor de inteligencia artificial generativa [ 2 ] que procesa el lenguaje natural.

-

- El motor de IA que utiliza el chatbot de la AOC es GPT-4o, de la empresa OpenAI.

- Se utiliza una instancia de Azure OpenAI ubicada en Europa.

- El motor funciona en base a un modelo de lenguaje de gran capacidad (Large Language Model, LLM), el cual está constituido por redes neuronales profundas entrenadas con enormes conjuntos de datos extraídos básicamente de Internet (páginas web, blogs, redes sociales, artículos científicos, libros, etc.)

El servicio ha sido adaptado por 1MillionBot, que se ha encargado de:

-

- Diseñar las instrucciones que permitan guiar al modelo de IA y seguir unas indicaciones.

- Preparar datasets, recolección y limpieza de datos que servirán como referencia para el sistema Retrieval Augmented Generation (RAG)

- Incorporación de datasets en el sistema RAG de 1MillionBot, que es capaz de mejorar la calidad de las respuestas utilizando contextos específicos.

- Pruebas de casos y validación de la capacidad del sistema para manejar errores y consultas complejas.

- Optimización del modelo basada en las interacciones de los usuarios.

Toda la infraestructura del servicio se encuentra alojada en la nube de Google Cloud Plataform (GCP), concretamente en el centro de datos de Google Cloud en Bélgica, dentro del Económico Europeo (EEE). Esta ubicación garantiza el cumplimiento de las normativas europeas de privacidad y seguridad.

El chatbot cuenta con un sistema para recoger la opinión de los usuarios y poder valorar la satisfacción de la conversación global.

Principales características de la arquitectura:

-

- Alojamiento seguro y certificado:

-

- Las instalaciones de GCP cumplen con los estándares de seguridad ISO 27001, i SOC 2/3, asegurando una infraestructura robusta y fiable.

- Toda la infraestructura del proveedor, 1MillionBot, incluyendo el webchat, la plataforma Millie (frontend) y la lógica y datos (backend), está alojada en este entorno.

-

- Aislamiento por casos de uso:

-

- Cada caso de uso del servicio está aislado en una red y entorno de desarrollo específicos, evitando interferencias entre aplicaciones y maximizando la seguridad.

-

- Almacenamiento protegido:

-

- Las preguntas y respuestas de las conversaciones se guardan en bases de datos alojadas en máquinas virtuales de Google Cloud, protegidas mediante cortafuegos avanzados y mecanismos de aislamiento.

- El acceso a estos datos se realiza exclusivamente a través del backend, asegurando un control riguroso.

-

- Protección contra ataques:

-

- El sistema incorpora varias capas de seguridad, tales como:

-

- Limitadores de solicitudes para prevenir sobrecargas.

- Validaciones estrictas de datos y acceso.

- Cortafuegos especializados para proteger la infraestructura.

-

- El sistema incorpora varias capas de seguridad, tales como:

-

- Alojamiento seguro y certificado:

Esta arquitectura asegura la robustez, seguridad y adaptabilidad necesarias para ofrecer un servicio de calidad a los usuarios.

Rendimiento del algoritmo

Tasa de acierto del 91,33%. Esta tasa se revisa con periodicidad mensual (última revisión: 15/04/2025)

Supervisión humana

El sistema algorítmico del chatbot actúa de forma directa, pero está debajo vigilancia ex post del personal responsable de la decisión final, especialmente intensificada en el período inicial de funcionamiento para compensar los sesgos del algoritmo y reducir las respuestas erróneas. Las respuestas del chatbot quedan fijas y no pueden modificarse.

La supervisión humana de los chatbots garantiza la calidad y precisión de las respuestas a través de un proceso riguroso y regular:

-

- Revisiones semanales: Los expertos revisan los registros de conversaciones para identificar respuestas incorrectas. Para cada error detectado, se anota la respuesta ideal y se reclasifican las frases de los usuarios con respuesta errónea, asignándolas al intento generativo más adecuado.

- Análisis mensual: Se evalúan 150 conversaciones seleccionadas aleatoriamente, junto a las ya identificadas como erróneas, para detectar patrones de error y corregir respuestas inadecuadas.

- Gestión de intentos: Cuando los errores no se pueden solucionar simplemente reclasificando frases, los expertos ajustan los prontos de los intentos existentes o crean nuevos intentos.

Este proceso combina la metodología tradicional de los chatbots con la flexibilidad de la IA generativa, garantizando una gestión ágil y un servicio fiable, alineado con las necesidades de los usuarios.

Cumplimiento normativo del sistema

El sistema no trata datos de carácter personal. Sin embargo, el sistema cumple con la normativa vigente en materia de protección de datos y seguridad. En especial:

-

- Se aplican los principios del Reglamento General de Protección de Datos (RGPD):

- Principio de minimización de datos: sólo se recogen los datos necesarios para cumplir con la finalidad del sistema.

-

- Principio de limitación de finalidad: los datos recogidos sólo se utilizan para la finalidad comunicada a la persona interessada.

- Se aplican los principios del Reglamento General de Protección de Datos (RGPD):

-

- Desde el punto de vista técnico, la solución cumple con los requisitos establecidos por el Esquema Nacional de Seguridad (ENS) para sistemas de nivel BAJO.

✨Aplicación voluntaria del Reglamento de Inteligencia Artificial de la Unión Europea (Reglamento de IA) [ 3 ]

El sistema cumple con los requisitos del Reglamento de IA exigibles en el caso de sistemas de IA de riesgo limitado i modelos de IA generativa sin riesgo sistémico. Por eso:

-

- Se informa a los usuarios que están interactuando con una IA desde el inicio. Por eso, el servicio se presenta como “Asistente virtual AOC” y no con un nombre de persona.

-

- Como IA generativa, los chatbots de la AOC también cumplen con los siguientes requisitos:

-

- Se revela que el contenido es generado por IA.

- Se publica un resumen sobre los datos de entrenamiento.

- Se proporciona información sobre el modelo de IA con lenguaje claro y accesible.

Los dos últimos puntos se cumplen con esta ficha de transparència algorítmica.

-

- Estos chatbots no están sujetos a los requisitos para IA generativa con riesgo sistémico. Esto significa que no es necesario que pasen evaluaciones de modelos ni pruebas contradictorias, ni tampoco debe reportarse sobre eficiencia energética.

- Como IA generativa, los chatbots de la AOC también cumplen con los siguientes requisitos:

Se trata de una ¿Actuación Administrativa Automatizada (AAA)? No.

En este caso la AOC no está sujeta a la obligación legal de publicar la AAA vinculada al servicio en la sede-e, acompañada de una ficha técnica (Véase el artículo 11, letra y, del Real decreto 203/2021 , por el que se aprueba el Reglamento de actuación y funcionamiento del sector público por medios electrónicos; Público)

Gestión de riesgos

Conoce los riesgos más probables en relación con los principios y derechos fundamentales que deben protegerse, y las medidas aplicadas en cada caso para mitigarlos o minimizarlos.

A. Igualdad y no discriminación

-

- Riesgos identificados: sesgos en los resultados, riesgo de exclusión y discriminación.

-

- El modelo LLM del motor GPT-4o, que constituye la base de los chatbots de la AOC, está preentrenado con grandes volúmenes de datos de Internet. Estos datos incluyen una amplia variedad de información y pueden contener prejuicios relacionados con el género, el origen étnico, la lengua, entre otros. Como resultado, el sistema puede reproducir patrones discriminatorios presentes en los datos de entrenamiento. Además, la complejidad de las redes neuronales dificulta la identificación y prevención de estos sesgos.

- Por otra parte, el catalán no es una de las principales lenguas utilizadas en el entrenamiento del modelo. Esto puede dar lugar a respuestas con un uso predominante de formas masculinas y una menor diversidad lingüística, afectando a la inclusividad y riqueza de las interacciones en esta lengua.

-

- Medidas aplicadas

-

- Datos de entrenamiento representatantes: Los datos utilizados para realizar el entrenamiento final y ajustar el chatbot han sido seleccionados cuidadosamente para incluir varios grupos de población y evitar sesgos explícitos a fin de garantizar que las respuestas sean los más representativas y justas posibles.

- Igualdad en el acceso lingüístico: El servicio se puede utilizar en catalán y castellano, con la opción de elegir el idioma al comienzo de la conversación o cambiarlo durante su uso. Esto permite que todos los usuarios puedan interactuar con el sistema en la lengua que prefieran.

-

- Actualmente, el chatbot pregunta a la persona usuaria en qué idioma prefiere ser atendida, puesto que así se mejora la precisión en las respuestas. Sin embargo, se están realizando pruebas para evaluar su rendimiento sin necesidad de preguntar el idioma.

-

- Interpretación tolerante del lenguaje: El sistema está diseñado para entender el lenguaje natural, aunque existan errores ortográficos o lingüísticos, asegurando que las personas usuarias no se vean penalizadas por pequeñas equivocaciones en sus consultas.

- Inclusión y diversidad en el diseño: Se ha trabajado en una interfaz del chatbot que cualquier persona pueda utilizar fácilmente, independientemente de su nivel de habilidad digital, para garantizar que todo el mundo pueda acceder al servicio sin barraeres tecnológicas.

-

- Riesgos identificados: sesgos en los resultados, riesgo de exclusión y discriminación.

B. Protección de datos, privacidad y libertad de elección

-

- Riesgos identificados: posible amenaza a la privacidad, mal uso de los datos personales por terceros y pérdida de la libertad de elección.

-

- El servicio nunca solicita información personal identificable. Sin embargo, el servicio implica un riesgo relacionado con el tratamiento de datos personales si la persona usuaria introduce datos personales innecesarios.

-

- Medidas aplicadas

-

- Para proteger los datos y la privacidad:

-

- El proveedor (1MillionBot) ha firmado un Encargo de Tratamiento con ubicación de los datos en la Unión Europea.

- El Responsable de Tratamiento (AOC) garantiza los derechos ARCO (Acceso, Rectificación, Cancelación y Oposición) de los datos tratados.

- Se gestiona el consentimiento y cookies.

- Los registros de conversación son revisados periódicamente por expertos que eliminan cualquier dato personal no detectado por el sistema.

- En la próxima versión, se implantará una función que borrará automáticamente cualquier número de seguridad social o correo electrónico introducido en el chat, y la persona usuaria podrá solicitar que su conversación sea eliminada del sistema.

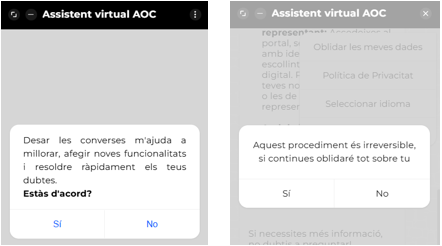

- Se informa a la persona usuaria que se guardará la conversación. Si no está de acuerdo, no puede continuar.

- El usuario puede borrar las conversaciones.

-

- Para garantizar la libertad de elección:

-

- Ofrecemos alternativas de atención a la ciudadanía sin el uso de algoritmos de IA, como la atención telefónica y por correo electrónico. Si la persona usuaria pide expresamente "contactar con soporte", "hablar con un agente", "quiero más apoyo", o similar, el bot redirige automáticamente a las páginas de contacto de apoyo de la AOC. Además, el chatbot se encuentra dentro de los propios portales de soporte de la AOC, donde también se puede acceder directamente a la opción “Contacta con soporte” desde el pie de página.

-

- Para proteger los datos y la privacidad:

-

- Riesgos identificados: posible amenaza a la privacidad, mal uso de los datos personales por terceros y pérdida de la libertad de elección.

C. Seguridad y robustez

-

- Riesgos identificados: difusión de información incorrecta, errores e incoherencias en las respuestas, indisponibilidad del servicio y acceso no autorizado a los datos.

-

- Los modelos basados en redes neuronales y cálculos probabilísticos dificultan la interpretación de cómo se llega al resultado final, lo que limita el control sobre las respuestas generadas. Además, la naturaleza de la IA generativa puede hacer que, en ocasiones, el sistema extraiga información más allá de su base de conocimiento específica, incluyendo fuentes o datos externos no verificados, lo que puede dar lugar a respuestas fuera de contexto o sobre temas que no pertenecen a su ámbito.

- Para mitigar estos riesgos, el motor de IA debe instalarse en un entorno controlado y protegido, con una configuración y securización rigurosas a fin de garantizar la protección y la integridad del servicio.

-

- Medidas aplicadas

-

- El sistema se ha instalado en un entorno cerrado y seguro, basado en una arquitectura certificada (vea las principales características de la arquitectura). Esta configuración garantiza:

- Robustez y fiabilidad, asegurando el correcto funcionamiento del sistema.

- Seguridad y confidencialidad de los datos gestionados.

-

- Adaptabilidad para ofrecer respuestas de calidad alineadas con las necesidades de los usuarios.

- Análisis de riesgos de seguridad: la AOC ha llevado a cabo una evaluación de seguridad siguiendo las guías de la Agencia Catalana de Ciberseguridad y del Esquema Nacional de Seguridad (ENS). El sistema se ha clasificado con un nivel de seguridad BAJO, y de acuerdo con esta categorización, se han implementado medidas específicas para mitigar los riesgos identificados. En concreto, para garantizar la disponibilidad y el correcto funcionamiento del sistema:

- Se han establecido Acuerdos de Nivel de Servicio (ANS) con el proveedor, que deben cumplirse y revisarse periódicamente, para asegurar la capacidad, disponibilidad y gestión de incidentes del sistema.

-

- Se realizan informes quincenales de cumplimiento de los ANS para garantizar que el servicio mantenga los estándares pactados.

- El sistema se ha instalado en un entorno cerrado y seguro, basado en una arquitectura certificada (vea las principales características de la arquitectura). Esta configuración garantiza:

-

- Para garantizar el derecho a una información veraz y adecuada: se aplican protocolos para revisar el sistema, minimizando errores e incoherencias, y mejorando la calidad de las respuestas. Además, para asegurar respuestas dentro del ámbito de competencia del chatbot:

-

- Se han implementado filtros de palabras clave y temas (p. ej. Certificado de empadronamiento, pago de una multa, preinscripción escolar,…). Estos filtros generan "intentos fuera de catálogo", con los que el chatbot informa que no dispone de información sobre el tema y recomienda ponerse en contacto con la administración correspondiente.

- El modelo se entrena exclusivamente con datos del dominio de la AOC, asegurando lo máximo posible que la información sea relevante y ajustada a su propósito.

-

- Para garantizar el derecho a una información veraz y adecuada: se aplican protocolos para revisar el sistema, minimizando errores e incoherencias, y mejorando la calidad de las respuestas. Además, para asegurar respuestas dentro del ámbito de competencia del chatbot:

-

- Riesgos identificados: difusión de información incorrecta, errores e incoherencias en las respuestas, indisponibilidad del servicio y acceso no autorizado a los datos.

D. Transparència y explicabilidad

-

- Riesgos identificados: desconfianza, interpretación errónea de los resultados por parte de los usuarios (incapacidad para comprender el resultado), confusión al pensar que se trata de una interacción con un humano, dificultades para presentar quejas o consultas sobre los resultados obtenidos

- Medidas aplicadas

-

- Identificación clara como IA: Desde el principio, el servicio se presenta como "asistente virtual" para evitar confusiones sobre la naturaleza de la interacción.

-

- Consentimiento de los usuarios: Se informa a los usuarios que la conversación será guardada, para que puedan decidir si desean continuar.

- Ficha de transparència algorítmica: Se publica en la web de la AOC, con información sobre:

-

- Problemática que se desea resolver

- Como se ha implementado el sistema de IA

- Público destinatario

- Datos utilizados para entrenar el sistema de IA

- Identidad y datos de contacto del proveedor

- Organismo responsable y dirección de contacto para quejas, consultas y sugerencias

-

- Acceso fácil a la ficha: La ficha de transparència se puede consultar desde la página de inicio del servicio.

-

E. Rendición de cuentas y auditabilidad

-

- Riesgos identificados: Limitaciones en la trazabilidad de los resultados, falta de verificación y revisión periódica, dificultades en la interpretación del modelo incluso por especialistas, ausencia de responsabilidad asignada.

-

- Los riesgos asociados a la rendición de cuentas y auditabilidad de los chatbots con IA generativa pueden poner en peligro la fiabilidad del sistema si no se dispone de medios para trazar con precisión el proceso de generación de respuestas, verificar la calidad de forma regular y garantizar que el funcionamiento sea comprensible incluso por especialistas. Estos factores dificultan la adecuada supervisión del servicio y complican la atribución de responsabilidades en caso de errores o decisiones injustas, lo que puede afectar a la confianza en el servicio público.

-

- Medidas aplicadas

-

- Para garantizar la rendición de cuentas del sistema de IA y sus resultados:

-

- Supervisión de calidad e impacto: Se realizan informes quincenales con indicadores de calidad y de impacto para evaluar si el servicio cumple los objetivos establecidos.

-

- Para garantizar la responsabilidad sobre el sistema y sus resultados:

- Se informa de quien es el responsable del servicio (AOC) y del procedimiento a seguir para presentar una queja en caso de impactos adversos.

- Para garantizar la auditabilidad:

-

- AOC se reserva el derecho de llevar a cabo auditorías adicionales para revisar los indicadores de calidad y los Acuerdos de Nivel de Servicio (ANS) en cualquier momento, garantizando así un seguimiento continuado de la fiabilidad del sistema.

-

- Para garantizar la rendición de cuentas del sistema de IA y sus resultados:

-

- Riesgos identificados: Limitaciones en la trazabilidad de los resultados, falta de verificación y revisión periódica, dificultades en la interpretación del modelo incluso por especialistas, ausencia de responsabilidad asignada.

F. Desarrollo sostenible y solidaridad

-

- Riesgos identificados: impacto negativo medioambiental, desigualdades en el acceso a esta tecnología por su elevado coste.

-

- El uso de chatbots con IA generativa plantea retos importantes en términos de sostenibilidad y equidad. Por un lado, su impacto ambiental es elevado, ya que requiere grandes recursos computacionales para el procesamiento y almacenamiento de datos, lo que implica un alto consumo energético y emisiones de CO₂. Por otro lado, su coste de implantación y mantenimiento es significativo, lo que puede limitar el acceso a esta tecnología a las organizaciones con mayores recursos.

-

- Medidas aplicadas

-

- Ajuste y optimización del entrenamiento del chatbot para conseguir la máxima eficiencia. Estudios indican que una consulta en ChatGPT puede equivaler a diez búsquedas con Google; por tanto, si esto se confirma, el elevado coste energético de la IA generativa podría compensarse con su mayor efectividad en comparación con métodos más económicos.

- Fomento de la transparència sobre los costes de uso para contribuir a un uso más responsable de esta tecnología.

-

- Fomento de la transferibilidad: AOC está trabajando para ofrecer el chatbot como servicio "llave en mano" a las administraciones locales catalanas, facilitando el acceso a esta tecnología de manera equitativa. Esta estrategia de replicabilidad permitirá la adopción de una IA generativa avanzada sin requerir grandes inversiones.

-

- Riesgos identificados: impacto negativo medioambiental, desigualdades en el acceso a esta tecnología por su elevado coste.

Más información

-

- Ficha del Registro de IA y otros algoritmos de la Generalitat: Botes de conversación de la AOC

- Ficha de innovación de la AOC: Chatbots con IA generativa de la AOC: atención inmediata, eficiente y accesible

- Artículo "IA generativa y ChatGPT. Impacto en el aprendizaje universitario”. De Clemente Nadeu Camprubí. Departamento Teoría de Señal y Comunicaciones (TSC). Centros de Investigación TALP e IDEAI. Universidad Politécnica de Cataluña (UPC).

[ 1 ] Un intención hace referencia a la intención o propósito que tiene la persona usuaria cuando formula una pregunta o realiza una consulta en el chatbot. Los intentos ayudan a identificar qué quiere conseguir la persona, por ejemplo, obtener información específica, resolver un problema o completar un trámite. En los chatbots tradicionales, los intentos deben predefinirse y entrenarse de forma manual para que el chatbot pueda reconocerlos y ofrecer la respuesta adecuada. En cambio, los chatbots con IA generativa pueden identificar e interpretar intentos de forma más flexible, ya que generan respuestas en tiempo real a partir del contexto de la conversación, sin necesidad de una clasificación exhaustiva de intentos de antemano. Esto hace que la interacción sea más natural y adaptada a las necesidades de la persona usuaria.

[ 2 ] Algunas de las principales capacidades del motor de inteligencia artificial generativa son:

-

- Identifica y corrige errores tipográficos y ortográficos para mejorar la comunicación.

- Detecta la intención del mensaje, incluso con frases ambiguas o con múltiples significados.

- Mantiene una memoria a corto plazo para conectar a preguntas y asegurar respuestas coherentes.

- Evalúa las posibles respuestas, elige la mejor y ofrece sugerencias para conversaciones más claras.

- Se adapta a varios idiomas (catalán, castellano, inglés), reconoce jergas y emojis.

[ 3 ] El Reglamento del Parlamento Europeo y el Consejo por el que se establecen normas armonizadas en materia de inteligencia artificial y se modifican determinados actos legislativos de la Unión (también conocido como RIA o AI Act) entró en vigor el 2 de agosto de 2024 y se aplicará a partir del 2 de agosto de 2026.