Transparència خوارزمي: روبوتات محادثة مزودة بذكاء اصطناعي توليدي لدعم مواطني منظمة AOC

ملخص

المشكلة التي من المفترض حلها بحلول نهاية عام 2023

-

- الحاجة إلى المساعدة المستمرة: يحتاج مستخدمو AOC إلى دعم مستمر على مدار 24 ساعة طوال أيام الأسبوع، ولكن الدعم وجهًا لوجه أو عبر الهاتف لا يمكن أن يضمن هذا التوفر الكامل.

- زيادة الاستفسارات والحوادث: الاستخدام المتزايد للخدمات الرقمية والبوابة الإلكترونية transparència أدى ارتفاع الطلب على المعلومات والمساعدة من قبل مكتب المدعي العام إلى زيادة ملحوظة في الطلب، حيث استقبل مركز خدمة المستخدمين أكثر من 91.000 طلب سنويًا (بيانات عام 2023). ولإدارة هذه الزيادة بكفاءة والحفاظ على التزام المركز تجاه المواطنين، يُعدّ هذا الوقت مناسبًا للنظر في دمج أدوات جديدة تُسهم في الاستخدام الأمثل للموارد.

- الفجوة الرقمية وصعوبات البحث: غالبًا ما يواجه العديد من المستخدمين، المتأثرين بالفجوة الرقمية والاجتماعية، صعوبة في معرفة ما يجب البحث عنه أو تفسير نتائج محركات البحث التقليدية بشكل صحيح. يمكن أن يؤدي ذلك إلى الارتباك والإحباط في تجربتك الرقمية، مما يستلزم المزيد من الدعم المخصص الذي يتيح سهولة الوصول إلى المعلومات ذات الصلة.

الحل المعتمد

-

- تطوير Chatbot باستخدام الذكاء الاصطناعي التوليدي: لتسهيل الحل الذاتي للاستفسارات بطريقة سهلة وفورية، تم إنشاء مساعدي المحادثة المعتمدين على الذكاء الاصطناعي. تتيح روبوتات الدردشة هذه الإجابة على الأسئلة الأكثر شيوعًا للمستخدمين باستخدام كميات كبيرة من البيانات والخوارزميات التي تفسر اللغة الطبيعية.

- لماذا تختار روبوتات الدردشة التوليدية المدعمة بالذكاء الاصطناعي؟ بدأت لجنة الطيران المدني تجربة روبوتات الدردشة منذ ما يقرب من عقد من الزمان، حيث أدخلتها تدريجيًا لتحسين دعم المستخدمين. في البداية، تم تطبيق روبوتات دردشة تقليدية مثل باولا (21/01/2021)، التي قدمت الدعم في عملية التحقق من الهوية باستخدام VÀLid؛ وريتا (29/04/2021)، التي ساعدت في الحصول على بطاقة الهوية واستخدامها وتجديدها.idCAT الشهادة، وبرنامج الدردشة الآلي الخاص بالبوابة transparència (19/4/2023)، مخصصة لحل الاستفسارات في هذا المجال. على الرغم من فائدتها، تعمل هذه الروبوتات الدردشة وفق قواعد وتدفقات منظمة من الأسئلة والأجوبة المحددة مسبقًا، مما يتطلب تدريبًا يدويًا مكثفًا، ويجعل تنفيذها معقدًا ومكلفًا، كما أنها تقدم إجابات بنجاح نسبي.انظر ملف transparència روبوتات الدردشة التقليدية التابعة لمنظمة AOC)

ومن خلال هذه التجربة، تلتزم AOC الآن بجيل جديد من روبوتات الدردشة المستندة إلى البيانات والذكاء الاصطناعي التوليدي، والتي تحتاج إلى تدريب أقل بكثير ويمكنها توفير استجابات أكثر تخصيصًا وسياقًا، وبالتالي تحسين تجربة المستخدم. بالإضافة إلى ذلك، تتيح هذه التقنية إعادة السؤال، أي إكمال السؤال الأولي مع الحفاظ على الاتساق مع المحادثة السابقة، بينما في روبوتات الدردشة التقليدية، يتم التعامل مع كل سؤال كما لو كان الأول.

لمن هي موجهة إلى؟

-

- المواطنون الذين يستخدمون خدمات AOC، لتزويدهم بدعم سهل الوصول وسريع وعلى مدار 24 ساعة.

استخدم حالات

يتم تطبيق Chatbots المزودة بالذكاء الاصطناعي التوليدي في خدمات AOC التالية:

-

- صالح: يساعد المواطنين في الاستفسارات الأكثر شيوعًا أثناء عملية تحديد الهوية على صفحة VALid.

- idCat متحركيساعد على تبديد الشكوك حول الحصول على واستخدام وتجديدidCat هاتف.

- idCat الشهادهيقدم الدعم في الحصول على واستخدام وتجديدidCat شهادة.

- نوتوم الإلكتروني: يحل الشكوك ويقدم الدعم في إدارة الإخطارات الإلكترونية.

- Representa: يساعد المواطنين والشركات على تبديد الشكوك حول representaالصلاحيات والسلطات.

- هـ- الحقيقة: يدعم إعداد وإدارة الفواتير الإلكترونية.

مستوى مخاطر نظام الذكاء الاصطناعي (وفقًا لمعايير لائحة الذكاء الاصطناعي الأوروبية)

-

- مخاطر محدودة. لا يُشكل خطرًا كبيرًا على صحة الأفراد أو سلامتهم أو حقوقهم الأساسية، ولا يؤثر بشكل جوهري على نتائج اتخاذ القرار.

حالة

-

- تم تنفيذه واستخدامه منذ مايو 2024، بمتوسط 11.575 مستخدمًا شهريًا.

اتفاقية مستوى الخدمة

-

- متاح 24 × 7 مع مستوى توافر 99,8%.

المزايا الرئيسية للخدمة

للمواطنين:

-

- الوصول إلى المعلومات على مدار 24 ساعة طوال أيام الأسبوع: يمكن للمواطنين الحصول على المساعدة في أي وقت، دون قيود زمنية، مما يسهل حل الشكوك عندما يحتاجون إليها.

- الرد الفوري: توفر Chatbots استجابات فورية، مما يتجنب أوقات الانتظار للقنوات التقليدية مثل الدعم وجهًا لوجه أو الدعم عبر الهاتف.

- الحل الذاتي للاستفسارات: يمكن للمستخدمين حل مشكلاتهم بشكل مستقل، مما يقلل من اعتمادهم على الدعم المباشر وتحسين التجربة.

- تحسين تجربة المستخدم: تتيح روبوتات الدردشة المزودة بتقنية الذكاء الاصطناعي التوليدي تفاعلًا طبيعيًا ووثيقًا بشكل أكبر، مما يسهل "المحادثة" الحقيقية مع المستخدم. يمكن لروبوتات الدردشة هذه التكيف مع طريقة كل شخص في التعبير عن نفسه، مما يسمح له بتحديد أو تحسين أسئلته باستخدام كلماته الخاصة.

للإدارة:

-

- تحسين الموارد: تتعامل Chatbots مع الاستعلامات المتكررة، مما يحرر الموظفين للقيام بمهام أكثر تعقيدًا، مما يحسن الوقت وكفاءة الموارد.

- تخفيض التكلفةكل استفسار يُجيب عليه روبوت المحادثة يكلف أقل بكثير من تكلفة الاهتمام البشري. تشير تقديرات أولية، استنادًا إلى بيانات من عام ٢٠٢٥، إلى أن الوفورات تبلغ حوالي 96% (متوسط التكلفة التقريبية 15 يورو للتشاور حضره موظفو CAU مقابل. 0,60 يورو عبر برنامج المحادثة الآلي).

ويعتبر هذا الرقم إرشاديا وسيتم تأكيده عند إجراء تحليل اقتصادي أكثر تفصيلا. - زيادة الكفاءة: تتعامل روبوتات الدردشة مع استعلامات متعددة في وقت واحد، مما يتجنب الاختناقات ويحسن الاستجابة.

- مجهود تدريبي أقل: تتطلب روبوتات الدردشة المولدة بالذكاء الاصطناعي إعدادًا وتدريبًا أوليًا أقل، بدءًا من نموذج عام تم تدريبه مسبقًا والذي يمكن تعديله بأقل قدر من التعديلات. تتكون عملية التعديل من مراجعة وتصحيح الإجابات غير الصحيحة التي تم اكتشافها، بدلاً من العمل بشكل شامل على تصنيف وهيكلة الإجابات لكل منها نية [1].

- التحسين المستمر للخدمات: يتيح تحليل المحادثة تحديد الأنماط وتحسين المجالات الرئيسية وتكييف الخدمات مع احتياجات المستخدم.

معلومات الاتصال

إدارة مفتوحة لكاتالونيا

فريق الاتصال للاستفسارات

المديرية الفرعية للاستراتيجية والابتكار

البريد الإلكتروني للفريق

Innovacio@aoc.cat

مليون بوت ، SL

البريد الإلكتروني للمورد

info@1millionbot.com

مزيد من المعلومات التفصيلية حول الخدمة

تعرف على البيانات والمعلومات التي يستخدمها النظام ومنطق تشغيل الخوارزميات وحوكمتها.

مجموعات البيانات

تعتمد القاعدة المعرفية لروبوتات الدردشة على ثلاثة مصادر رئيسية:

-

- الأسئلة المتداولة (الأسئلة الشائعة): يتم تدريب روبوتات المحادثة في البداية باستخدام قاعدة بيانات للأسئلة الشائعة المتوفرة على بوابة الدعم. تجمع هذه الأسئلة الشائعة الاستفسارات الأكثر شيوعًا من المواطنين ويتم تحديثها بأحدث المعلومات حول الخدمة.

- التذاكر المتكررة: وتتعلم برامج المحادثة أيضًا من تحليل تذاكر الدعم التاريخية التي تحتوي على معلومات حول أسئلة المستخدمين وشكوكهم وحوادثهم وكيفية حلها.

- ردود الفعل المستمرة: يقدم نظام الدردشة الآلية شكلاً من أشكال التعلم المستمر حيث تحتوي كل محاولة توليدية على سلسلة من العبارات التدريبية التي يتم تغذيتها من خلال محادثات المستخدم. إذا طرح شخص سؤالاً جديدًا، سيحاول برنامج المحادثة الآلي البحث عن أوجه التشابه في قاعدة عبارات التدريب الموجودة لديه. إذا قام روبوت المحادثة بإنشاء إجابة غير صحيحة على هذا السؤال، أثناء فترة مراجعة المحادثة، سيتم تضمين العبارة ضمن المحاولة المقابلة وسوف يقوم الذكاء الاصطناعي بإنشاء اختلافات منها للحصول على قاعدة معرفية أكثر شمولاً.

بيانات الإدخال الأخرى:

-

- بيانات المستخدم: لا يتم استخدام أي بيانات شخصية للمستخدمين لتدريب النموذج.

اعتبارات بشأن معالجة البيانات وحفظها

-

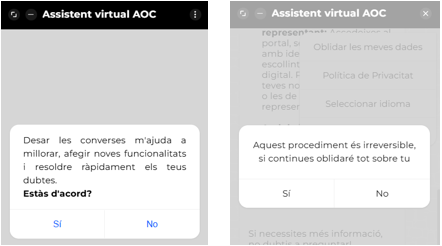

- يقوم نظام الذكاء الاصطناعي بتسجيل الأسئلة المطروحة والإجابات المقدمة خلال جلسة الدردشة في ملف. كما يقوم أيضًا بإنشاء تقارير تحتوي على بيانات الاستخدام والمحادثات والإحصائيات عبر الإنترنت للتحليل وتحسين الخدمة.

- يتم الاحتفاظ بالمحادثات لمدة أقصاها 3 أشهر، وبعد ذلك يتم حذفها تلقائيًا.

- يتم الاحتفاظ بتقارير الاستخدام، بما في ذلك المعلمات مثل معدلات الاستخدام والاستجابة، إلى أجل غير مسمى لضمان إمكانية التتبع والتقييم المستمر للخدمة.

معالجة البيانات

يعتمد المنطق التشغيلي للمعالجة التلقائية للبيانات والمنطق الذي يقوم به النظام على النموذج والمنهجية التالية:

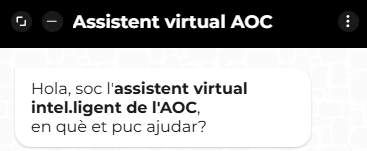

عملية التفاعل بين المستخدم وchatbot

تتم عملية التفاعل بين المستخدم وchatbot من خلال واجهة رقمية يمكن الوصول إليها من أجهزة مثل الويب أو الهاتف المحمول أو الجهاز اللوحي. يقوم المستخدم بإدخال سؤال بصيغة نصية ("مطالبة") يصف المعلومات التي يريد الحصول عليها. يقوم برنامج الدردشة الآلية بمعالجة هذه المعلومات ويقوم بإنشاء استجابة نصية لتوفير المعلومات المطلوبة.

بنية الخدمة

تستخدم الخدمة أ محرك الذكاء الاصطناعي التوليدي [2] الذي يعالج اللغة الطبيعية.

-

- محرك الذكاء الاصطناعي الذي يستخدمه برنامج الدردشة الآلي AOC هو جي بي تي-4oمن شركة OpenAI.

- يتم استخدام مثيل Azure OpenAI الموجود في أوروبا.

- يعمل المحرك على أساس نموذج لغوي كبير (Large Language Model, LLM) يتكون من شبكات عصبية عميقة مدربة بمجموعات بيانات ضخمة مستخرجة بشكل أساسي من الإنترنت (صفحات الويب، المدونات، شبكات التواصل الاجتماعي، مقالات العلماء، الكتب) ، إلخ.)

لقد كانت الخدمة مقتبس بواسطة 1MillionBot، والتي كانت مسؤولة عن:

-

- صمم التعليمات التي تسمح لنموذج الذكاء الاصطناعي بتوجيه التوجيهات واتباعها.

- إعداد مجموعات البيانات وجمع وتنظيف البيانات التي ستكون بمثابة مرجع لنظام الجيل المعزز للاسترجاع (RAG)

- دمج مجموعات البيانات في نظام RAG الخاص بـ 1MillionBot، والذي يمكنه تحسين جودة الإجابات باستخدام سياقات محددة.

- اختبار الحالات والتحقق من قدرة النظام على التعامل مع الأخطاء والاستعلامات المعقدة.

- تحسين النموذج على أساس تفاعلات المستخدم.

تتم استضافة البنية التحتية الكاملة للخدمة في سحابة منصة جوجل السحابية (GCP)، وتحديدًا في مركز بيانات Google Cloud في بلجيكا، داخل المنطقة الاقتصادية الأوروبية (EEA). يضمن هذا الموقع الامتثال للوائح الخصوصية والأمن الأوروبية.

يحتوي برنامج chatbot على نظام لجمع آراء المستخدمين والقدرة على تقييم مدى رضاهم عن المحادثة الشاملة.

الخصائص الرئيسية للهندسة المعمارية:

-

- سكن آمن ومعتمد:

-

- تتوافق عمليات تثبيت Google Cloud Platform مع معايير الأمان ISO 27001 i سوك 2/3، مما يضمن بنية تحتية قوية وموثوقة.

- جميع البنية التحتية للمزود، 1 مليون بوت، بما في ذلك الدردشة عبر الإنترنت ومنصة Millie (الواجهة الأمامية) والمنطق والبيانات (الواجهة الخلفية)، تتم استضافتها في هذه البيئة.

-

- العزل حسب حالات الاستخدام:

-

- يتم عزل كل حالة استخدام للخدمة في شبكة محددة وبيئة تطوير معينة، مما يؤدي إلى تجنب التداخل بين التطبيقات وزيادة الأمان.

-

- تخزين محمي:

-

- يتم تخزين أسئلة المحادثة وإجاباتها في قواعد البيانات المستضافة على أجهزة Google Cloud الافتراضية، والتي تكون محمية بجدران الحماية المتقدمة وآليات العزل.

- يتم الوصول إلى هذه البيانات حصريًا من خلال الواجهة الخلفية، مما يضمن رقابة صارمة.

-

- الحماية ضد الهجمات:

-

- يتضمن النظام عدة طبقات من الأمان، مثل:

-

- محددات الطلب لمنع التحميل الزائد.

- عمليات التحقق الصارمة للبيانات والوصول إليها.

- جدران الحماية المتخصصة لحماية البنية التحتية.

-

- يتضمن النظام عدة طبقات من الأمان، مثل:

-

- سكن آمن ومعتمد:

تضمن هذه البنية المتانة والأمان والقدرة على التكيف اللازمة لتقديم خدمة عالية الجودة للمستخدمين.

أداء الخوارزمية

نسبة النجاح 91,33%. يتم مراجعة هذا السعر شهريا (آخر مراجعة: 15/04/2025)

إشراف بشري

يعمل النظام الخوارزمي لروبوت الدردشة بشكل مباشر، لكنه تحت ذلك المراقبة اللاحقة من الموظفين المسؤولين عن القرار النهائي، وخاصة في الفترة الأولى من التشغيل للتعويض عن تحيزات الخوارزمية وتقليل الإجابات الخاطئة. استجابات Chatbot ثابتة ولا يمكن تعديلها.

يضمن الإشراف البشري على روبوتات الدردشة جودة ودقة الاستجابات من خلال عملية صارمة ومنتظمة:

-

- المراجعات الأسبوعية: يقوم الخبراء بمراجعة سجلات الدردشة لتحديد الإجابات غير الصحيحة. بالنسبة لكل خطأ يتم اكتشافه، يتم تدوين الإجابة المثالية وإعادة تصنيف جمل المستخدم ذات الإجابة الخاطئة، وتعيينها للمحاولة التوليدية الأكثر ملاءمة.

- التحليل الشهري: يتم تقييم 150 محادثة تم اختيارها عشوائيًا، إلى جانب تلك التي تم تحديدها بالفعل على أنها خاطئة، لاكتشاف أنماط الخطأ وتصحيح الاستجابات غير المناسبة.

- إدارة المحاولات: عندما لا يمكن إصلاح الأخطاء بمجرد إعادة تصنيف الجمل، يقوم الخبراء بضبط مطالبات المحاولات الحالية أو إنشاء محاولات جديدة.

تجمع هذه العملية بين المنهجية التقليدية لروبوتات الدردشة ومرونة الذكاء الاصطناعي التوليدي، مما يضمن إدارة مرنة وخدمة موثوقة، تتماشى مع احتياجات المستخدمين.

الامتثال التنظيمي للنظام

لا يقوم النظام بمعالجة البيانات الشخصية. ومع ذلك، فإن النظام يتوافق مع اللوائح الحالية المتعلقة بحماية البيانات وأمنها. بخاصة:

-

- تنطبق مبادئ اللائحة العامة لحماية البيانات (RGPD):

- مبدأ تقليل البيانات: يتم جمع البيانات الضرورية فقط لتحقيق غرض النظام.

-

- مبدأ تحديد الغرض: لا تُستخدم البيانات التي تم جمعها إلا للغرض الذي تم إبلاغه للفرد المعني.eresحزين.

- تنطبق مبادئ اللائحة العامة لحماية البيانات (RGPD):

-

- من وجهة نظر فنية، يتوافق الحل مع المتطلبات التي وضعها نظام الأمن القومي (ENS) للأنظمة ذات المستوى المنخفض.

✨التطبيق الطوعي لائحة الاتحاد الأوروبي للذكاء الاصطناعي (لائحة الذكاء الاصطناعي) [3]

يتوافق النظام مع متطلبات لائحة الذكاء الاصطناعي المطلوبة في حالة أنظمة الذكاء الاصطناعي للمخاطر محدود i نماذج الذكاء الاصطناعي التوليدية دون مخاطر نظامية. لهذا السبب:

-

- يتم إعلام المستخدمين بأنهم يتفاعلون مع الذكاء الاصطناعي منذ البداية. ولهذا السبب، يتم تقديم الخدمة على أنها "مساعد افتراضي لـ AOC" وليس باسم شخصي.

-

- مثل الذكاء الاصطناعي التوليدي, تفي روبوتات الدردشة AOC أيضًا بالمتطلبات التالية:

-

- تم الكشف عن أن المحتوى تم إنشاؤه بواسطة الذكاء الاصطناعي.

- يتم نشر ملخص لبيانات التدريب.

- يتم توفير المعلومات حول نموذج الذكاء الاصطناعي بلغة واضحة وسهلة المنال.

يتم تلبية النقطتين الأخيرتين من خلال ورقة البيانات هذه. transparència خوارزمي.

-

- لا تخضع روبوتات الدردشة هذه لمتطلبات الذكاء الاصطناعي التوليدي مع وجود مخاطر نظامية. وهذا يعني أنه ليست هناك حاجة لاجتياز تقييمات النماذج أو الاختبارات المتناقضة، كما أنه ليس من الضروري الإبلاغ عن كفاءة استخدام الطاقة.

- مثل الذكاء الاصطناعي التوليدي, تفي روبوتات الدردشة AOC أيضًا بالمتطلبات التالية:

إنها الإجراء الإداري الآلي (AAA)؟ رقم

في هذه الحالة، لا تخضع شركة AOC للالتزام القانوني بنشر AAA المرتبط بالخدمة على موقعها الإلكتروني، مصحوبًا بملف فني (انظر المادة 11، الحرف الأول من المرسوم السلطاني 203/2021، الذي يوافق على اللائحة التنظيمية الخاصة بالخدمة) أداء وتشغيل القطاع العام بالوسائل الإلكترونية، والذي ينشر القانون رقم 40/2015 بشأن النظام القانوني للقطاع العام)

إدارة المخاطر

تعرف على مخاطر أكثر احتمالا فيما يتعلق ب المبادئ والحقوق الأساسية التي يجب حمايتها، والتدابير المطبقة في كل حالة للتخفيف منها أو التقليل منها.

أ. المساواة وعدم التمييز

-

- المخاطر المحددة: التحيز في النتائج، وخطر الاستبعاد والتمييز.

-

- تم تدريب نموذج LLM لمحرك GPT-4o، والذي يشكل أساس روبوتات الدردشة AOC، مسبقًا بكميات كبيرة من البيانات من الإنترنت. تتضمن هذه البيانات مجموعة واسعة من المعلومات وقد تحتوي على تحيزات تتعلق بالجنس والأصل العرقي واللغة وغيرها. ونتيجة لذلك، يمكن للنظام إعادة إنتاج الأنماط التمييزية الموجودة في بيانات التدريب. بالإضافة إلى ذلك، فإن تعقيد الشبكات العصبية يجعل من الصعب تحديد هذه التحيزات ومنعها.

- من ناحية أخرى، الكاتالونية ليست إحدى اللغات الرئيسية المستخدمة في التدريب النموذجي. ويمكن أن يؤدي ذلك إلى استجابات ذات استخدام سائد لصيغ المذكر وتنوع لغوي أقل، مما يؤثر على شمولية وثراء التفاعلات في تلك اللغة.

-

- التدابير المطبقة

-

- بيانات التدريب representaتشنجاتتم اختيار البيانات المستخدمة في التدريب النهائي وتعديل برنامج الدردشة الآلي بعناية لتشمل فئات سكانية متنوعة وتجنب التحيزات الصريحة لضمان أن تكون الاستجابات هي الأكثر دقة. representaممكن وعادل.

- المساواة في الوصول اللغوي: يمكن استخدام الخدمة باللغتين الكاتالونية والإسبانية، مع إمكانية اختيار اللغة في بداية المحادثة أو تغييرها أثناء الاستخدام. يتيح ذلك لجميع المستخدمين التفاعل مع النظام باللغة التي يفضلونها.

-

- حاليًا، يسأل برنامج الدردشة الآلي المستخدم عن اللغة التي يفضل أن يتم تقديم الخدمة بها، حيث يؤدي ذلك إلى تحسين دقة الإجابات. ومع ذلك، يتم إجراء اختبارات لتقييم أدائها دون الحاجة إلى السؤال عن اللغة.

-

- تفسير متسامح للغة: النظام مصمم لفهم اللغة الطبيعية، حتى لو كانت هناك أخطاء إملائية أو لغوية، مما يضمن عدم معاقبة المستخدمين بسبب الأخطاء الصغيرة في استفساراتهم.

- الشمول والتنوع في التصميمتم العمل على واجهة روبوت محادثة يمكن لأي شخص استخدامها بسهولة، بغض النظر عن مستوى مهاراته الرقمية، لضمان وصول الجميع إلى الخدمة دون عوائق.eres تكنولوجي.

-

- المخاطر المحددة: التحيز في النتائج، وخطر الاستبعاد والتمييز.

ب. حماية البيانات والخصوصية وحرية الاختيار

-

- المخاطر المحددة: التهديد المحتمل للخصوصية وإساءة استخدام البيانات الشخصية من قبل أطراف ثالثة وفقدان حرية الاختيار.

-

- لا تطلب الخدمة أبدًا معلومات تعريف شخصية. ومع ذلك، تنطوي الخدمة على مخاطر تتعلق بمعالجة البيانات الشخصية إذا قام المستخدم بإدخال بيانات شخصية غير ضرورية.

-

- التدابير المطبقة

-

- لحماية البيانات والخصوصية:

-

- قام المزود (1MillionBot) بتوقيع أمر معالجة بموقع البيانات داخل الاتحاد الأوروبي.

- يضمن مراقب البيانات (AOC) حقوق ARCO (الوصول والتصحيح والإلغاء والمعارضة) للبيانات المعالجة.

- تتم إدارة الموافقة وملفات تعريف الارتباط.

- تتم مراجعة سجلات المحادثات بانتظام من قبل الخبراء الذين يقومون بإزالة أي بيانات شخصية لم يكتشفها النظام.

- في الإصدار التالي، سيتم تنفيذ ميزة ستقوم تلقائيًا بحذف أي رقم ضمان اجتماعي أو بريد إلكتروني تم إدخاله في الدردشة، وسيتمكن المستخدم من طلب إزالة محادثته من النظام.

- يتم إعلام المستخدم بأنه سيتم حفظ المحادثة. إذا كنت لا توافق، لا يمكنك الاستمرار.

- يمكن للمستخدم حذف المحادثات.

-

- لضمان حرية الاختيار:

-

- نحن نقدم بدائل لمساعدة المواطنين دون استخدام خوارزميات الذكاء الاصطناعي، مثل الدعم عبر الهاتف والبريد الإلكتروني. إذا طلب المستخدم على وجه التحديد "الاتصال بالدعم"، أو "التحدث إلى وكيل"، أو "أريد المزيد من الدعم"، أو ما شابه ذلك، فسيقوم الروبوت تلقائيًا بإعادة التوجيه إلى صفحات الاتصال بدعم AOC. بالإضافة إلى ذلك، يوجد برنامج الدردشة الآلي داخل بوابات دعم AOC نفسها، حيث يمكنك أيضًا الوصول مباشرة إلى خيار "الاتصال بالدعم" من التذييل.

-

- لحماية البيانات والخصوصية:

-

- المخاطر المحددة: التهديد المحتمل للخصوصية وإساءة استخدام البيانات الشخصية من قبل أطراف ثالثة وفقدان حرية الاختيار.

ج. السلامة والمتانة

-

- المخاطر المحددة: نشر معلومات غير صحيحة، وأخطاء وتناقضات في الاستجابات، وعدم توفر الخدمة، والوصول غير المصرح به إلى البيانات.

-

- النماذج المعتمدة على الشبكات العصبية والحسابات الاحتمالية تجعل من الصعب تفسير كيفية الوصول إلى النتيجة النهائية، مما يحد من التحكم في الاستجابات المتولدة. بالإضافة إلى ذلك، قد تؤدي طبيعة الذكاء الاصطناعي التوليدي أحيانًا إلى قيام النظام باستخلاص معلومات تتجاوز قاعدة معارفه المحددة، بما في ذلك مصادر أو بيانات خارجية لم يتم التحقق منها، مما قد يؤدي إلى ردود خارج السياق أو حول موضوعات لا تنتمي إلى مجالها .

- وللتخفيف من هذه المخاطر، يجب تثبيت محرك الذكاء الاصطناعي في بيئة خاضعة للرقابة ومحمية، مع تكوين وأمان صارمين لضمان الحماية وسلامة الخدمة.

-

- التدابير المطبقة

-

- تم تثبيت النظام في بيئة مغلقة وآمنة، بناءً على بنية معتمدة (انظر الخصائص الرئيسية للبنية). يضمن هذا التكوين:

- المتانة والموثوقية، مما يضمن التشغيل الصحيح للنظام.

- أمن وسرية البيانات المدارة.

-

- القدرة على التكيف لتقديم إجابات عالية الجودة تتماشى مع احتياجات المستخدمين.

- تحليل المخاطر الأمنية:أجرت AOC تقييمًا أمنيًا وفقًا لإرشادات وكالة الأمن السيبراني الكاتالونية والمخطط الأمني الوطني (ENS). تم تصنيف النظام بمستوى أمان منخفض، ووفقًا لهذا التصنيف، تم تنفيذ تدابير محددة للتخفيف من المخاطر التي تم تحديدها. وعلى وجه التحديد، لضمان التوفر والتشغيل الصحيح للنظام:

- تم إنشاء اتفاقيات مستوى الخدمة (SLAs) مع المورد، والتي يجب الالتزام بها ومراجعتها بشكل دوري، لضمان قدرة النظام وتوافره وإدارة الحوادث.

-

- يتم إعداد تقارير امتثال ANS كل نصف شهر لضمان احتفاظ الخدمة بالمعايير المتفق عليها.

- تم تثبيت النظام في بيئة مغلقة وآمنة، بناءً على بنية معتمدة (انظر الخصائص الرئيسية للبنية). يضمن هذا التكوين:

-

- لضمان الحق في أ معلومات صادقة وكافية: يتم تطبيق البروتوكولات لمراجعة النظام وتقليل الأخطاء والتناقضات وتحسين جودة الاستجابات. بالإضافة إلى ذلك، لضمان الاستجابات ضمن نطاق اختصاص chatbot:

-

- تم تنفيذ مرشحات الكلمات الرئيسية والموضوعات (مثل شهادة التسجيل، ودفع الغرامة، والتسجيل المسبق في المدرسة، وما إلى ذلك). تولد هذه المرشحات "محاولات خارج الكتالوج"، حيث يُعلم برنامج الدردشة الآلي أنه ليس لديه معلومات حول الموضوع ويوصي بالاتصال بالإدارة ذات الصلة.

- يتم تدريب النموذج حصريًا على البيانات من مجال AOC، مما يضمن قدر الإمكان أن تكون المعلومات ذات صلة ومناسبة للغرض.

-

- لضمان الحق في أ معلومات صادقة وكافية: يتم تطبيق البروتوكولات لمراجعة النظام وتقليل الأخطاء والتناقضات وتحسين جودة الاستجابات. بالإضافة إلى ذلك، لضمان الاستجابات ضمن نطاق اختصاص chatbot:

-

- المخاطر المحددة: نشر معلومات غير صحيحة، وأخطاء وتناقضات في الاستجابات، وعدم توفر الخدمة، والوصول غير المصرح به إلى البيانات.

D. Transparència وقابلية التفسير

-

- المخاطر المحددة: عدم الثقة، سوء تفسير النتائج من قبل المستخدمين (عدم القدرة على فهم النتيجة)، الارتباك في الاعتقاد بأنه تفاعل مع إنسان، صعوبات في تقديم الشكاوى أو الاستفسارات حول النتائج التي تم الحصول عليها

- التدابير المطبقة

-

- تعريف واضح كـ AI: منذ البداية، يتم تقديم الخدمة على أنها "مساعد افتراضي" لتجنب الالتباس حول طبيعة التفاعل.

-

- موافقة المستخدم: سيتم إعلام المستخدمين بأن المحادثة سيتم حفظها، حتى يتمكنوا من تحديد ما إذا كانوا يريدون الاستمرار أم لا.

- ملف transparència خوارزمي: يتم نشره على موقع AOC، مع معلومات عن:

-

- المشكلة التي يتعين حلها

- مع تطبيق نظام الذكاء الاصطناعي

- الجمهور المستهدف

- البيانات المستخدمة لتدريب نظام الذكاء الاصطناعي

- هوية وتفاصيل الاتصال بالمورد

- الجهة المسؤولة وعنوان الاتصال للشكاوى والاستفسارات والاقتراحات

-

- سهولة الوصول إلى الملف: ورقة من transparència يمكن الاطلاع عليه من الصفحة الرئيسية للخدمة.

-

هـ. الاحتفاظ بالحسابات وقابلية التدقيق

-

- المخاطر التي تم تحديدها: القيود في إمكانية تتبع النتائج، وعدم التحقق والمراجعة الدورية، وصعوبات في تفسير النموذج حتى من قبل المتخصصين، وغياب المسؤولية المسندة.

-

- يمكن للمخاطر المرتبطة بالمساءلة وقابلية التدقيق لروبوتات الدردشة المنتجة للذكاء الاصطناعي أن تعرض موثوقية النظام للخطر إذا لم تكن هناك وسيلة لتتبع عملية توليد الاستجابة بدقة، والتحقق من الجودة على أساس منتظم، والتأكد من أن العملية مفهومة حتى من قبل المتخصصين. هذه العوامل تجعل من الصعب الإشراف على الخدمة بشكل صحيح وتجعل من الصعب إسناد المسؤولية عن الأخطاء أو القرارات غير العادلة، والتي يمكن أن تؤثر على الثقة في الخدمة العامة.

-

- التدابير المطبقة

-

- لضمان مساءلة نظام الذكاء الاصطناعي ونتائجه:

-

- مراقبة الجودة والأثر: يتم إعداد تقارير نصف أسبوعية تتضمن مؤشرات الجودة والأثر لتقييم ما إذا كانت الخدمة تلبي الأهداف المحددة.

-

- لضمان المسؤولية عن النظام ونتائجه:

- يتم إبلاغ المسؤول عن الخدمة (AOC) والإجراءات الواجب اتباعها لتقديم شكوى في حالة حدوث آثار سلبية.

- لضمان قابلية التدقيق:

-

- تحتفظ AOC بالحق في إجراء عمليات تدقيق إضافية لمراجعة مؤشرات الجودة واتفاقيات مستوى الخدمة (SLAs) في أي وقت، وبالتالي ضمان المراقبة المستمرة لموثوقية النظام.

-

- لضمان مساءلة نظام الذكاء الاصطناعي ونتائجه:

-

- المخاطر التي تم تحديدها: القيود في إمكانية تتبع النتائج، وعدم التحقق والمراجعة الدورية، وصعوبات في تفسير النموذج حتى من قبل المتخصصين، وغياب المسؤولية المسندة.

واو - التنمية المستدامة والتضامن

-

- المخاطر التي تم تحديدها:التأثير البيئي السلبي، وعدم المساواة في الوصول إلى هذه التكنولوجيا بسبب تكلفتها العالية.

-

- ويشكل استخدام روبوتات المحادثة مع الذكاء الاصطناعي تحديات كبيرة من حيث الاستدامة والمساواة. ومن ناحية أخرى، فإن تأثيرها البيئي مرتفع، لأنها تتطلب موارد حسابية ضخمة لمعالجة البيانات وتخزينها، مما يعني استهلاكًا كبيرًا للطاقة وانبعاثات ثاني أكسيد الكربون. ومن ناحية أخرى، فإن تكلفة تنفيذها وصيانتها كبيرة، مما قد يحد من الوصول إلى هذه التكنولوجيا للمؤسسات التي لديها المزيد من الموارد.

-

- التدابير المطبقة

-

- ضبط وتحسين تدريب Chatbot لتحقيق أقصى قدر من الكفاءة. تشير الدراسات إلى أن استعلام ChatGPT واحد يمكن أن يعادل عشر عمليات بحث على Google؛ لذلك، إذا تم تأكيد ذلك، فيمكن تعويض تكلفة الطاقة المرتفعة للذكاء الاصطناعي التوليدي من خلال فعاليته الأكبر مقارنة بالطرق الأرخص.

- الترويج لـ transparència حول تكاليف الاستخدام للمساهمة في استخدام أكثر مسؤولية لهذه التكنولوجيا.

-

- تعزيز قابلية النقل:تعمل AOC على تقديم روبوت المحادثة كخدمة "جاهزة للاستخدام" للإدارات المحلية الكتالونية، مما يسهل الوصول إلى هذه التكنولوجيا بطريقة عادلة. ستسمح استراتيجية التكرار هذه بتبني الذكاء الاصطناعي التوليدي المتقدم دون الحاجة إلى استثمارات كبيرة.

-

- المخاطر التي تم تحديدها:التأثير البيئي السلبي، وعدم المساواة في الوصول إلى هذه التكنولوجيا بسبب تكلفتها العالية.

معلومات اكثر

-

- ملف سجل الذكاء الاصطناعي والخوارزميات الأخرى التابعة لحكومة أيرلندا الشمالية: روبوتات دردشة AOC

- ورقة ابتكارات لجنة الاتصالات الفيدرالية: روبوتات الدردشة مع الذكاء الاصطناعي التوليدي من AOC: اهتمام فوري وفعال وسهل الوصول إليه

- شرط "الذكاء الاصطناعي التوليدي وChatGPT. التأثير على التعلم الجامعي". بقلم كليمنت نادو كامبروبي. قسم نظرية الإشارة والاتصالات (TSC). مراكز أبحاث TALP وIDEAI. جامعة البوليتكنيك في كاتالونيا (UPC).

[1] Un نية يشير إلى النية أو الغرض الذي يمتلكه المستخدم عند طرح سؤال أو إجراء استعلام إلى chatbot. تساعد المحاولات في تحديد ما يريد الشخص تحقيقه، مثل الحصول على معلومات محددة، أو حل مشكلة، أو إكمال عملية. في روبوتات الدردشة التقليدية، يجب أن تكون المحاولات محددة مسبقًا وتدريبها يدويًا حتى يتمكن روبوت الدردشة من التعرف عليها وتقديم الاستجابة المناسبة. في المقابل، يمكن لروبوتات الدردشة المزودة بالذكاء الاصطناعي التوليدي تحديد المحاولات وتفسيرها بشكل أكثر مرونة من خلال إنشاء استجابات في الوقت الفعلي استنادًا إلى سياق المحادثة، دون الحاجة إلى إجراء محاولات شاملة مسبقًا. وهذا يجعل التفاعل أكثر طبيعية ومتكيفًا مع احتياجات المستخدم.

[2] بعض القدرات الرئيسية لل محرك الذكاء الاصطناعي التوليدي نكون:

-

- تحديد وتصحيح الأخطاء المطبعية والإملائية لتحسين التواصل.

- يكتشف هدف الرسالة، حتى مع الجمل الغامضة أو المعاني المتعددة.

- يحافظ على الذاكرة قصيرة المدى لربط الأسئلة والتأكد من الإجابات المتسقة.

- يقوم بتقييم الإجابات المحتملة، ويختار أفضلها، ويقدم اقتراحات لمحادثات أكثر وضوحًا.

- يتكيف مع عدة لغات (الكتالونية، الإسبانية، الإنجليزية)، ويتعرف على العامية والرموز التعبيرية.

[3] El لائحة البرلمان الأوروبي والمجلس التي تضع قواعد منسقة بشأن الذكاء الاصطناعي وتعديل بعض القوانين التشريعية للاتحاد (المعروف أيضًا باسم قانون RIA أو قانون الذكاء الاصطناعي) دخل حيز التنفيذ في 2 أغسطس 2024 وسيبدأ تطبيقه اعتبارًا من 2 أغسطس 2026.