Transparència Algoritmisch: Chatbots met generatieve AI ter ondersteuning van AOC-burgers

Overzicht

Probleem dat eind 2023 opgelost moet zijn

-

- Nood aan voortdurende hulp: AOC-gebruikers hebben continue, 24/7 ondersteuning nodig, maar persoonlijke of telefonische ondersteuning kan deze volledige beschikbaarheid niet garanderen.

- Toename van vragen en incidenten: Het toenemende gebruik van digitale diensten en het portaal van transparència De toename van de vraag naar informatie en hulp door de AOC heeft geleid tot meer dan 91.000 jaarlijkse aanvragen (gegevens uit 2023) die door het Klantenservicecentrum (CAU) worden afgehandeld. Om deze toename efficiënt te beheren en de betrokkenheid van het CAU bij de burgers te waarborgen, is dit een goed moment om te overwegen nieuwe instrumenten te implementeren die helpen de middelen te optimaliseren.

- Digitale kloof en zoekproblemen: Veel gebruikers, getroffen door de digitale en sociale kloof, hebben vaak moeite met weten waarnaar ze moeten zoeken of met het correct interpreteren van de resultaten van traditionele zoekmachines. Dit kan leiden tot verwarring en frustratie in uw digitale ervaring, waardoor meer op maat gemaakte ondersteuning nodig is die gemakkelijke toegang tot relevante informatie mogelijk maakt.

Aangenomen oplossing

-

- Chatbotontwikkeling met generatieve AI: Om het zelf oplossen van vragen op een toegankelijke en directe manier te vergemakkelijken, zijn op AI gebaseerde gespreksassistenten gemaakt. Deze chatbots maken het mogelijk om de meest voorkomende vragen van gebruikers te beantwoorden door gebruik te maken van grote hoeveelheden data en algoritmen die natuurlijke taal interpreteren.

- Waarom kiezen voor generatieve AI-chatbots? De AOC begon bijna tien jaar geleden te experimenteren met chatbots en introduceerde ze geleidelijk om de gebruikersondersteuning te verbeteren. Aanvankelijk werden conventionele chatbots geïmplementeerd, zoals Paula (21-01-2021), die het identificatieproces met VÀLid ondersteunde; en Rita (29-04-2021), die hielp bij het verkrijgen, gebruiken en vernieuwen van deidCAT Certificaat en de chatbot van het portaal transparència (19-4-2023), gewijd aan het oplossen van vragen op dit gebied. Ondanks hun nut werken deze chatbots met regels en gestructureerde stromen van vooraf gedefinieerde vragen en antwoorden, wat intensieve handmatige training vereist, de implementatie complex en kostbaar maakt, en bovendien slechts met relatief succes antwoorden oplevert.Zie het bestand van transparència Conventionele AOC-chatbots)

Met deze ervaring zet het AOC zich nu in voor een nieuwe generatie chatbots op basis van data en generatieve AI, die veel minder training nodig hebben en meer op maat gemaakte en gecontextualiseerde antwoorden kunnen bieden, waardoor de gebruikerservaring wordt verbeterd. Bovendien maakt deze technologie het opnieuw stellen mogelijk, dat wil zeggen het voltooien van de initiële vraag, terwijl de consistentie met het vorige gesprek behouden blijft, terwijl bij conventionele chatbots elke vraag wordt behandeld alsof het de eerste is.

Aan wie is het gericht?

-

- Burgers die gebruik maken van de diensten van het AOC, om hen toegankelijke, snelle en 24-uurs ondersteuning te bieden.

Gebruiksgevallen

Chatbots met generatieve AI worden toegepast in de volgende AOC-diensten:

-

- GELDIG: helpt burgers bij de meest voorkomende vragen tijdens het identificatieproces op de VALid-pagina.

- idCat MobielHelpt bij het wegnemen van twijfels over het verkrijgen, gebruiken en verlengen van deidCat Telefoon.

- idCat certificaat: biedt ondersteuning bij het verkrijgen, gebruiken en verlengen van deidCat Certificaat.

- e-NOTUM: lost twijfels op en biedt ondersteuning bij het beheer van elektronische meldingen.

- RepresentaHelpt burgers en bedrijven bij het oplossen van twijfels over de representabevoegdheden en machten.

- e.FEIT: biedt ondersteuning bij het opstellen en beheren van elektronische facturen.

Risiconiveau van het AI-systeem (volgens de criteria van de Europese AI-verordening)

-

- Beperkt risico. Vormt geen significant risico op schade aan de gezondheid, veiligheid of fundamentele rechten van individuen, noch heeft het een substantiële invloed op de uitkomst van de besluitvorming.

Toestand

-

- Geïmplementeerd en in gebruik sinds mei 2024, met gemiddeld 11.575 maandelijkse gebruikers.

Serviceniveauovereenkomst

-

- 24×7 beschikbaar met een beschikbaarheidsniveau van 99,8%.

Belangrijkste voordelen van de service

Voor burgers:

-

- 24/7 toegang tot informatie: Burgers kunnen op elk moment hulp krijgen, zonder tijdsbeperkingen, waardoor het oplossen van twijfels wordt vergemakkelijkt wanneer zij die nodig hebben.

- Onmiddellijke reactie: Chatbots bieden directe antwoorden en vermijden de wachttijden van traditionele kanalen zoals face-to-face of telefonische ondersteuning.

- Zelfoplossing van vragen: Gebruikers kunnen hun problemen autonoom oplossen, waardoor ze minder afhankelijk zijn van directe ondersteuning en de ervaring wordt verbeterd.

- Verbeterde gebruikerservaring: Chatbots met generatieve AI zorgen voor een meer natuurlijke en nauwe interactie, waardoor een authentiek ‘gesprek’ met de gebruiker mogelijk wordt gemaakt. Deze chatbots kunnen zich aanpassen aan de manier waarop elke persoon zich uitdrukt, waardoor ze hun vraag in hun eigen woorden kunnen specificeren of verfijnen.

Voor administratie:

-

- Optimalisatie van hulpbronnen: Chatbots verwerken repetitieve vragen, waardoor personeel vrijkomt voor complexere taken, wat de tijd- en middelenefficiëntie verbetert.

- Kostenreductie: Elke vraag die door de chatbot wordt opgelost, kost veel minder dan menselijke aandacht. Een voorlopige schatting met gegevens uit 2025 schat de besparing op ongeveer 96% (geschatte gemiddelde kosten van €15 voor overleg bijgewoond door CAU-personeel vs. €0,60 via chatbot).

Dit cijfer is indicatief en zal worden bevestigd wanneer een meer gedetailleerde economische analyse wordt uitgevoerd. - Verhoogde efficiëntie: Chatbots behandelen meerdere vragen tegelijk, vermijden knelpunten en verbeteren de responsiviteit.

- Minder trainingsinspanning: Generatieve AI-chatbots vereisen minder initiële installatie en training, beginnend bij een algemeen, vooraf getraind model dat zich aanpast met minimale aanpassingen. Het aanpassingsproces bestaat uit het beoordelen en corrigeren van gedetecteerde onjuiste antwoorden, in plaats van uitputtend te werken aan de classificatie en structurering van antwoorden voor elk antwoord. aandachtig [1].

- Continue verbetering van de dienstverlening: Conversatieanalyse maakt het mogelijk om patronen te identificeren, belangrijke gebieden te verbeteren en diensten aan te passen aan de behoeften van de gebruiker.

Contactgegevens

Open bestuur van Catalonië

Neem contact op met het team voor vragen

Onderdirectoraat Strategie en Innovatie

Team-e-mail

innovacio@aoc.cat

EEN MILJOEN BOT, SL

E-mail van leverancier

info@1millionbot.com

Meer gedetailleerde informatie over de dienst

Maak uzelf vertrouwd met de gegevens en informatie die door het systeem worden gebruikt, de werkingslogica van de algoritmen en het beheer ervan.

Gegevenssets

De kennisbank van chatbots is gebaseerd op drie hoofdbronnen:

-

- Veelgestelde vragen (FAQ's): Chatbots worden in eerste instantie getraind met een database met veelgestelde vragen die beschikbaar is op het ondersteuningsportal. In deze FAQ's worden de meest voorkomende vragen van burgers verzameld en bijgewerkt met de meest recente informatie over de dienst.

- Terugkerende kaartjes: Chatbots leren ook van de analyse van historische supporttickets. Deze bevatten informatie over de vragen, twijfels en incidenten van gebruikers en hoe deze zijn opgelost.

- Continue feedback: Het chatbotsysteem biedt een vorm van constant leren, waarbij elke generatieve poging een reeks trainingszinnen bevat die gevoed worden door gebruikersgesprekken. Als iemand een nieuwe vraag stelt, zal de chatbot proberen overeenkomsten te vinden in de bestaande trainingszinnen. Als de chatbot tijdens de beoordelingsperiode van het gesprek een onjuist antwoord op deze vraag genereert, wordt de zinsnede opgenomen in de bijbehorende poging en genereert de AI variaties hiervan om een uitgebreidere kennisbasis te verkrijgen.

Overige invoergegevens:

-

- Gebruikersgegevens: Er worden geen persoonlijke gegevens van gebruikers gebruikt om het model te trainen.

Overwegingen over de gegevensverwerking en -behoud

-

- Het AI-systeem legt de tijdens de chatsessie gestelde vragen en de gegeven antwoorden vast in een bestand. Het genereert ook rapporten met gebruiksgegevens, gesprekken en onlinestatistieken voor analyse en serviceverbetering.

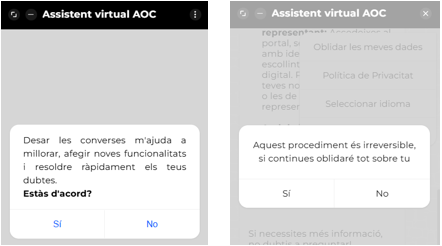

- Gesprekken worden maximaal 3 maanden bewaard, daarna worden ze automatisch verwijderd.

- Gebruiksrapporten, inclusief parameters zoals gebruik en responspercentages, worden voor onbepaalde tijd bewaard om de traceerbaarheid en voortdurende evaluatie van de service te garanderen.

Gegevensverwerking

De operationele logica van automatische gegevensverwerking en de redenering die door het systeem wordt uitgevoerd, is gebaseerd op het volgende model en de volgende methodologie:

Interactieproces tussen gebruiker en chatbot

Het interactieproces tussen gebruiker en chatbot vindt plaats via een digitale interface die toegankelijk is vanaf apparaten zoals internet, mobiel of tablet. De gebruiker voert een vraag in tekstformaat ("prompt") in die de informatie beschrijft die hij wil verkrijgen. De chatbot verwerkt deze informatie en genereert een tekstantwoord om de gevraagde informatie te verstrekken.

Service-architectuur

De dienst maakt gebruik van een generatieve kunstmatige intelligentie-engine [2] dat natuurlijke taal verwerkt.

-

- De AI-engine die door de AOC-chatbot wordt gebruikt, is GPT-4o, van het bedrijf OpenAI.

- Er wordt gebruikgemaakt van een Azure OpenAI-instantie in Europa.

- De engine werkt op basis van een groot taalmodel (Large Language Model, LLM), dat bestaat uit diepe neurale netwerken die zijn getraind met enorme datasets die voornamelijk van internet zijn gehaald (webpagina's, blogs, sociale netwerken, artikelen van wetenschappers, boeken enz.)

De dienst is geweest aangepast door 1MillionBot, die verantwoordelijk is geweest voor:

-

- Ontwerp de instructies waarmee het AI-model aanwijzingen kan sturen en volgen.

- Datasets voorbereiden, verzamelen en opschonen van gegevens die als referentie zullen dienen voor het Retrieval Augmented Generation (RAG)-systeem

- Integratie van datasets in het RAG-systeem van 1MillionBot, dat de kwaliteit van de antwoorden kan verbeteren met behulp van specifieke contexten.

- Test cases en valideer het vermogen van het systeem om fouten en complexe vragen af te handelen.

- Modeloptimalisatie op basis van gebruikersinteracties.

De gehele infrastructuur van de dienst wordt gehost in de cloud van Google Cloudplatform (GCP), specifiek in het Google Cloud-datacenter in België, binnen de Europese Economische Ruimte (EER). Deze locatie waarborgt dat wordt voldaan aan de Europese privacy- en veiligheidsregelgeving.

De chatbot heeft een systeem om de mening van de gebruikers te verzamelen en de tevredenheid van het algehele gesprek te kunnen beoordelen.

Belangrijkste kenmerken van de architectuur:

-

- Veilige en gecertificeerde accommodatie:

-

- GCP-installaties voldoen aan de beveiligingsnormen ISO 27001 i SOC 2/3, waardoor een robuuste en betrouwbare infrastructuur wordt gewaarborgd.

- Alle infrastructuur van de provider, 1 miljoenBot, inclusief webchat, het Millie-platform (frontend) en logica en data (backend), wordt in deze omgeving gehost.

-

- Isolatie door gebruiksscenario's:

-

- Elke gebruikscasus van de dienst wordt geïsoleerd in een specifieke netwerk- en ontwikkelomgeving, waardoor interferentie tussen applicaties wordt vermeden en de veiligheid wordt gemaximaliseerd.

-

- Beschermde opslag:

-

- Gespreksvragen en -antwoorden worden opgeslagen in databases die worden gehost op virtuele machines van Google Cloud, die worden beschermd door geavanceerde firewalls en isolatiemechanismen.

- Toegang tot deze gegevens vindt uitsluitend plaats via de backend, waardoor een strikte controle is gewaarborgd.

-

- Bescherming tegen aanvallen:

-

- Het systeem omvat verschillende beveiligingslagen, zoals:

-

- Vraag begrenzers aan om overbelasting te voorkomen.

- Strenge validaties van gegevens en toegang.

- Gespecialiseerde firewalls om de infrastructuur te beschermen.

-

- Het systeem omvat verschillende beveiligingslagen, zoals:

-

- Veilige en gecertificeerde accommodatie:

Deze architectuur zorgt voor de robuustheid, veiligheid en aanpassingsvermogen die nodig zijn om gebruikers een kwaliteitsvolle dienstverlening te bieden.

Prestaties van algoritmen

91,33% succespercentage. Dit tarief wordt maandelijks herzien (laatste herziening: 15/04/2025)

Menselijk toezicht

Het algoritmische systeem van de chatbot handelt direct, maar staat onder toezicht achteraf van het personeel dat verantwoordelijk is voor de uiteindelijke beslissing, vooral geïntensiveerd in de beginperiode van de operatie om vooroordelen van algoritmen te compenseren en foute antwoorden te verminderen. Chatbotreacties staan vast en kunnen niet worden gewijzigd.

Menselijk toezicht op chatbots garandeert de kwaliteit en nauwkeurigheid van de reacties via een rigoureus en regelmatig proces:

-

- Wekelijkse beoordelingen: Experts bekijken chatlogboeken om onjuiste antwoorden te identificeren. Voor elke gedetecteerde fout wordt het ideale antwoord genoteerd en worden gebruikerszinnen met het verkeerde antwoord opnieuw geclassificeerd, waarbij ze worden toegewezen aan de meest geschikte generatieve poging.

- Maandelijkse analyse: Er worden 150 willekeurig geselecteerde gesprekken geëvalueerd, samen met de gesprekken die al als onjuist zijn geïdentificeerd, om foutpatronen op te sporen en ongepaste reacties te corrigeren.

- Pogingbeheer: Wanneer fouten niet kunnen worden verholpen door simpelweg zinnen opnieuw te classificeren, passen experts de aanwijzingen van bestaande pogingen aan of creëren ze nieuwe pogingen.

Dit proces combineert de traditionele methodologie van chatbots met de flexibiliteit van generatieve AI, waardoor een flexibel beheer en een betrouwbare service worden gegarandeerd, afgestemd op de behoeften van de gebruikers.

Naleving van de regelgeving van het systeem

Het systeem verwerkt geen persoonsgegevens. Toch voldoet het systeem aan de huidige regelgeving op het gebied van gegevensbescherming en beveiliging. In het bijzonder:

-

- De principes van de Algemene Verordening Gegevensbescherming (RGPD) zijn van toepassing:

- Principe van gegevensminimalisatie: alleen de gegevens die nodig zijn om het doel van het systeem te vervullen, worden verzameld.

-

- Principe van doelbinding: de verzamelde gegevens worden alleen gebruikt voor het doel dat aan de betrokkene is meegedeeld.eresset.

- De principes van de Algemene Verordening Gegevensbescherming (RGPD) zijn van toepassing:

-

- Vanuit technisch oogpunt voldoet de oplossing aan de eisen van het National Security Scheme (ENS) voor systemen op laag niveau.

✨Vrijwillige toepassing van Verordening inzake kunstmatige intelligentie van de Europese Unie (AI-verordening) [3]

Het systeem voldoet aan de eisen die de AI-Verordening stelt in het geval van risicovolle AI-systemen beperkt i generatieve AI-modellen zonder systeemrisico. Dat is waarom:

-

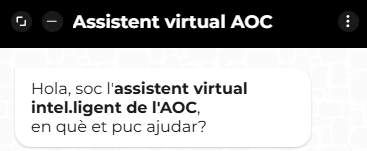

- Gebruikers worden vanaf het begin geïnformeerd dat ze interactie hebben met een AI. Om deze reden wordt de dienst gepresenteerd als "AOC virtuele assistent" en niet met een persoonlijke naam.

-

- Als generatieve AI, AOC-chatbots voldoen ook aan de volgende vereisten:

-

- Er wordt onthuld dat de inhoud wordt gegenereerd door AI.

- Er wordt een samenvatting van de trainingsgegevens gepubliceerd.

- Informatie over het AI-model wordt in duidelijke en toegankelijke taal gegeven.

Aan de laatste twee punten wordt in dit gegevensblad voldaan. transparència algoritmisch.

-

- Deze chatbots vallen niet onder de eisen voor generatieve AI met systeemrisico. Dit betekent dat het niet nodig is om modelevaluaties of tegenstrijdige tests te doorstaan, en ook niet hoeft te rapporteren over de energie-efficiëntie.

- Als generatieve AI, AOC-chatbots voldoen ook aan de volgende vereisten:

Het is een Geautomatiseerde administratieve actie (AAA)? Nee.

In dit geval is het AOC niet onderworpen aan de wettelijke verplichting om de AAA die aan de dienst is gekoppeld, op zijn website te publiceren, vergezeld van een technische fiche (zie artikel 11, letter i, van Koninklijk Besluit 203/2021, dat de Verordening inzake de prestaties en werking van de publieke sector via elektronische middelen, die wet 40/2015 betreffende het wettelijke regime van de publieke sector implementeert)

Risicomanagement

Ken de waarschijnlijker risico’s met betrekking tot de fundamentele beginselen en rechten die moeten worden beschermd, en de maatregelen die in elk geval worden toegepast om deze te verzachten of te minimaliseren.

A. Gelijkheid en non-discriminatie

-

- Geïdentificeerde risico's: vooroordelen in de resultaten, risico op uitsluiting en discriminatie.

-

- Het LLM-model van de GPT-4o-engine, die de basis vormt van de AOC-chatbots, is vooraf getraind met grote hoeveelheden gegevens van internet. Deze gegevens bevatten een grote verscheidenheid aan informatie en kunnen vooroordelen bevatten met betrekking tot onder meer geslacht, etnische afkomst en taal. Als gevolg hiervan kan het systeem discriminerende patronen reproduceren die aanwezig zijn in de trainingsgegevens. Bovendien maakt de complexiteit van neurale netwerken het moeilijk om deze vooroordelen te identificeren en te voorkomen.

- Aan de andere kant is Catalaans niet een van de belangrijkste talen die worden gebruikt bij modeltraining. Dit kan resulteren in reacties met een overheersend gebruik van mannelijke vormen en minder taalkundige diversiteit, waardoor de inclusiviteit en rijkdom van interacties in die taal worden aangetast.

-

- Maatregelen toegepast

-

- Trainingsgegevens representatievenDe gegevens die gebruikt zijn voor de uiteindelijke training en aanpassing van de chatbot zijn zorgvuldig geselecteerd om diverse bevolkingsgroepen te omvatten en expliciete vooroordelen te vermijden, zodat de antwoorden zo nauwkeurig mogelijk zijn. representamogelijk en eerlijk.

- Gelijkheid in taaltoegang: De dienst kan worden gebruikt in het Catalaans en Spaans, met de mogelijkheid om de taal aan het begin van het gesprek te kiezen of deze tijdens het gebruik te wijzigen. Hierdoor kunnen alle gebruikers met het systeem communiceren in de taal van hun voorkeur.

-

- Momenteel vraagt de chatbot aan de gebruiker in welke taal hij/zij het liefst bediend wil worden, omdat dit de nauwkeurigheid van de antwoorden ten goede komt. Er worden echter tests uitgevoerd om de prestaties ervan te beoordelen zonder dat u dit aan de taal hoeft te vragen.

-

- Tolerante interpretatie van taal: Het systeem is ontworpen om natuurlijke taal te begrijpen, zelfs als er spel- of taalfouten in voorkomen, zodat gebruikers niet worden gestraft voor kleine fouten in hun zoekopdrachten.

- Inclusie en diversiteit in ontwerpEr is gewerkt aan een chatbot-interface die iedereen gemakkelijk kan gebruiken, ongeacht hun digitale vaardigheden, om ervoor te zorgen dat iedereen zonder belemmeringen toegang heeft tot de dienst.eres technologisch.

-

- Geïdentificeerde risico's: vooroordelen in de resultaten, risico op uitsluiting en discriminatie.

B. Gegevensbescherming, privacy en keuzevrijheid

-

- Geïdentificeerde risico's: mogelijke bedreiging van de privacy, misbruik van persoonsgegevens door derden en verlies van keuzevrijheid.

-

- De service vraagt nooit om persoonlijk identificeerbare informatie. De dienst brengt echter een risico met zich mee dat verband houdt met de verwerking van persoonsgegevens als de gebruiker onnodige persoonsgegevens invoert.

-

- Maatregelen toegepast

-

- Om gegevens en privacy te beschermen:

-

- De aanbieder (1MillionBot) heeft een Verwerkingsopdracht getekend met de locatie van de gegevens binnen de Europese Unie.

- De Gegevensbeheerder (AOC) garandeert de ARCO-rechten (Toegang, Rectificatie, Annulering en Oppositie) van de verwerkte gegevens.

- Toestemming en cookies worden beheerd.

- Gesprekslogboeken worden regelmatig beoordeeld door experts die alle persoonlijke gegevens verwijderen die niet door het systeem zijn gedetecteerd.

- In de volgende versie zal een functie worden geïmplementeerd die automatisch elk burgerservicenummer of e-mailadres verwijdert dat in de chat is ingevoerd, en de gebruiker kan verzoeken dat zijn of haar gesprek uit het systeem wordt verwijderd.

- De gebruiker wordt geïnformeerd dat het gesprek wordt opgeslagen. Als u het er niet mee eens bent, kunt u niet doorgaan.

- De gebruiker kan de gesprekken verwijderen.

-

- Om de keuzevrijheid te garanderen:

-

- Wij bieden alternatieven om burgers te helpen zonder gebruik te maken van AI-algoritmen, zoals telefonische en e-mailondersteuning. Als de gebruiker specifiek vraagt om “contact op te nemen met de ondersteuning”, “met een agent te praten”, “Ik wil meer ondersteuning” of iets dergelijks, wordt de bot automatisch doorgestuurd naar de contactpagina's van AOC-ondersteuning. Bovendien bevindt de chatbot zich binnen de AOC-ondersteuningsportals zelf, waar u ook rechtstreeks toegang heeft tot de optie “Contact opnemen met ondersteuning” vanuit de voettekst.

-

- Om gegevens en privacy te beschermen:

-

- Geïdentificeerde risico's: mogelijke bedreiging van de privacy, misbruik van persoonsgegevens door derden en verlies van keuzevrijheid.

C. Veiligheid en robuustheid

-

- Geïdentificeerde risico's: verspreiding van onjuiste informatie, fouten en inconsistenties in antwoorden, onbeschikbaarheid van de dienst en ongeoorloofde toegang tot gegevens.

-

- Modellen gebaseerd op neurale netwerken en probabilistische berekeningen maken het moeilijk om te interpreteren hoe het eindresultaat wordt bereikt, wat de controle over de gegenereerde reacties beperkt. Bovendien kan de aard van generatieve AI er af en toe voor zorgen dat het systeem informatie buiten zijn specifieke kennisbasis haalt, inclusief niet-geverifieerde externe bronnen of gegevens, wat kan resulteren in reacties die niet tot hun vakgebied behoren .

- Om deze risico’s te beperken moet de AI-engine worden geïnstalleerd in een gecontroleerde en beschermde omgeving, met strikte configuratie en beveiliging om bescherming en service-integriteit te garanderen.

-

- Maatregelen toegepast

-

- Het systeem is geïnstalleerd in een gesloten en beveiligde omgeving, op basis van een gecertificeerde architectuur (zie de belangrijkste kenmerken van de architectuur). Deze configuratie zorgt voor:

- Robuustheid en betrouwbaarheid, waardoor de juiste werking van het systeem wordt gegarandeerd.

- Beveiliging en vertrouwelijkheid van beheerde gegevens.

-

- Aanpassingsvermogen, om kwaliteitsvolle antwoorden te bieden die zijn afgestemd op de behoeften van gebruikers.

- Analyse van veiligheidsrisico's: Het AOC heeft een veiligheidsbeoordeling uitgevoerd volgens de richtlijnen van het Catalaanse Agentschap voor cyberveiligheid en het Nationale Veiligheidsplan (ENS). Het systeem is geclassificeerd met een LAAG beveiligingsniveau. In overeenstemming met deze categorisering zijn specifieke maatregelen geïmplementeerd om de geïdentificeerde risico's te beperken. Om specifiek te zorgen voor de beschikbaarheid en correcte werking van het systeem:

- Met de leverancier zijn Service Level Agreements (SLA's) opgesteld, die periodiek moeten worden nageleefd en herzien om de systeemcapaciteit, beschikbaarheid en incidentbeheer te garanderen.

-

- Tweewekelijks worden ANS-nalevingsrapporten uitgevoerd om ervoor te zorgen dat de dienst de overeengekomen normen handhaaft.

- Het systeem is geïnstalleerd in een gesloten en beveiligde omgeving, op basis van een gecertificeerde architectuur (zie de belangrijkste kenmerken van de architectuur). Deze configuratie zorgt voor:

-

- Om het recht op een waarheidsgetrouwe en adequate informatie: protocollen worden toegepast om het systeem te herzien, fouten en inconsistenties te minimaliseren en de kwaliteit van de reacties te verbeteren. Om bovendien te zorgen voor reacties die binnen de competentie van de chatbot vallen:

-

- Er zijn trefwoord- en onderwerpfilters geïmplementeerd (bijv. Inschrijvingsbewijs, Betaling van een boete, Voorinschrijving op school, enz.). Deze filters genereren ‘pogingen buiten de catalogus’, waarmee de chatbot laat weten dat hij geen informatie over het onderwerp heeft en adviseert om contact op te nemen met de betreffende administratie.

- Het model wordt uitsluitend getraind op gegevens uit het AOC-domein, waarbij er zoveel mogelijk voor wordt gezorgd dat de informatie relevant en geschikt voor het beoogde doel is.

-

- Om het recht op een waarheidsgetrouwe en adequate informatie: protocollen worden toegepast om het systeem te herzien, fouten en inconsistenties te minimaliseren en de kwaliteit van de reacties te verbeteren. Om bovendien te zorgen voor reacties die binnen de competentie van de chatbot vallen:

-

- Geïdentificeerde risico's: verspreiding van onjuiste informatie, fouten en inconsistenties in antwoorden, onbeschikbaarheid van de dienst en ongeoorloofde toegang tot gegevens.

D. Transparència en verklaarbaarheid

-

- Geïdentificeerde risico's: wantrouwen, verkeerde interpretatie van de resultaten door gebruikers (onvermogen om het resultaat te begrijpen), verwarring bij het denken dat het om een interactie met een mens gaat, moeilijkheden bij het indienen van klachten of vragen over de verkregen resultaten

- Maatregelen toegepast

-

- Duidelijke identificatie als AI: Vanaf het begin wordt de dienst gepresenteerd als een ‘virtuele assistent’ om verwarring over de aard van de interactie te voorkomen.

-

- Toestemming van gebruiker: Gebruikers worden geïnformeerd dat het gesprek wordt opgeslagen, zodat ze kunnen beslissen of ze willen doorgaan.

- Bestand van transparència algoritmisch: Het wordt gepubliceerd op de AOC-website, met informatie over:

-

- Probleem dat moet worden opgelost

- Met het AI-systeem geïmplementeerd

- Doelgroep

- Gegevens die worden gebruikt om het AI-systeem te trainen

- Identiteits- en contactgegevens van de leverancier

- Verantwoordelijke instantie en contactadres voor klachten, vragen en suggesties

-

- Gemakkelijke toegang tot het blad: Het blad van transparència Het is te raadplegen via de homepage van de dienst.

-

E. Bewaren van rekeningen en controleerbaarheid

-

- Geïdentificeerde risico's: Beperkingen in de traceerbaarheid van de resultaten, gebrek aan verificatie en periodieke evaluatie, moeilijkheden bij de interpretatie van het model, zelfs door specialisten, afwezigheid van toegewezen verantwoordelijkheid.

-

- De risico’s die gepaard gaan met de verantwoording en controleerbaarheid van generatieve AI-chatbots kunnen de betrouwbaarheid van het systeem in gevaar brengen als er geen middelen zijn om het proces voor het genereren van reacties nauwkeurig te volgen, de kwaliteit regelmatig te verifiëren en ervoor te zorgen dat de werking zelfs voor specialisten begrijpelijk is. Deze factoren maken het moeilijk om goed toezicht te houden op de dienst en maken het moeilijk om de verantwoordelijkheid voor fouten of oneerlijke beslissingen toe te wijzen, wat het vertrouwen in de openbare dienst kan aantasten.

-

- Maatregelen toegepast

-

- Om de verantwoording van het AI-systeem en de resultaten ervan te garanderen:

-

- Kwaliteits- en impactmonitoring: Er wordt tweewekelijks gerapporteerd met kwaliteits- en impactindicatoren om te beoordelen of de dienstverlening voldoet aan de gestelde doelstellingen.

-

- Om de verantwoordelijkheid voor het systeem en de resultaten ervan te garanderen:

- Er wordt geïnformeerd wie verantwoordelijk is voor de dienst (AOC) en welke procedure moet worden gevolgd om een klacht in te dienen in geval van nadelige gevolgen.

- Om de controleerbaarheid te garanderen:

-

- Het AOC behoudt zich het recht voor om op elk moment aanvullende audits uit te voeren om kwaliteitsindicatoren en Service Level Agreements (SLA's) te beoordelen, waardoor voortdurende monitoring van de systeembetrouwbaarheid wordt gegarandeerd.

-

- Om de verantwoording van het AI-systeem en de resultaten ervan te garanderen:

-

- Geïdentificeerde risico's: Beperkingen in de traceerbaarheid van de resultaten, gebrek aan verificatie en periodieke evaluatie, moeilijkheden bij de interpretatie van het model, zelfs door specialisten, afwezigheid van toegewezen verantwoordelijkheid.

F. Duurzame ontwikkeling en solidariteit

-

- Geïdentificeerde risico's: negatieve gevolgen voor het milieu, ongelijkheid in toegang tot deze technologie vanwege de hoge kosten.

-

- Het gebruik van chatbots met generatieve AI brengt aanzienlijke uitdagingen met zich mee op het gebied van duurzaamheid en gelijkheid. Enerzijds is de impact op het milieu groot, omdat er veel rekenkracht nodig is voor de verwerking en opslag van gegevens, wat een hoog energieverbruik en een hoge CO₂-uitstoot met zich meebrengt. Aan de andere kant zijn de kosten voor implementatie en onderhoud aanzienlijk, wat de toegang tot deze technologie kan beperken tot organisaties met meer middelen.

-

- Maatregelen toegepast

-

- Afstemming en optimalisatie van chatbottraining om maximale efficiëntie te bereiken. Uit onderzoek blijkt dat één ChatGPT-zoekopdracht gelijk kan zijn aan tien Google-zoekopdrachten; Daarom zouden, indien bevestigd, de hoge energiekosten van generatieve AI kunnen worden gecompenseerd door de grotere effectiviteit ervan in vergelijking met goedkopere methoden.

- Bevordering van transparència over gebruikskosten om bij te dragen aan een meer verantwoord gebruik van deze technologie.

-

- Bevorderen van overdraagbaarheidHet AOC streeft ernaar om de chatbot als een kant-en-klare service aan te bieden aan de lokale Catalaanse overheden, zodat deze technologie op een eerlijke manier toegankelijk wordt. Deze repliceerbaarheidsstrategie maakt de implementatie van geavanceerde generatieve AI mogelijk zonder dat er grote investeringen nodig zijn.

-

- Geïdentificeerde risico's: negatieve gevolgen voor het milieu, ongelijkheid in toegang tot deze technologie vanwege de hoge kosten.

meer informatie

-

- Dossier van het register van AI en andere algoritmen van de Generalitat: AOC-chatbots

- AOC-innovatieblad: Chatbots met de generatieve AI van AOC: directe, efficiënte en toegankelijke aandacht

- Artikel "Generatieve AI en ChatGPT. Impact op universitair leren". Door Climent Nadeu Camprubí. Afdeling Signaal- en Communicatietheorie (TSC). TALP- en IDEAI-onderzoekscentra. Polytechnische Universiteit van Catalonië (UPC).

[1] Un aandachtig verwijst naar de intentie of het doel dat de gebruiker heeft bij het stellen van een vraag of het stellen van een vraag aan de chatbot. Pogingen helpen bij het identificeren van wat de persoon wil bereiken, zoals het verkrijgen van specifieke informatie, het oplossen van een probleem of het voltooien van een proces. Bij traditionele chatbots moeten pogingen vooraf worden gedefinieerd en handmatig worden getraind, zodat de chatbot ze kan herkennen en het juiste antwoord kan geven. Chatbots met generatieve AI kunnen daarentegen pogingen flexibeler identificeren en interpreteren door realtime antwoorden te genereren op basis van de context van het gesprek, zonder dat er vooraf een uitgebreide classificatie van pogingen nodig is. Dit maakt de interactie natuurlijker en aangepast aan de behoeften van de gebruiker.

[2] Enkele van de belangrijkste mogelijkheden van de generatieve kunstmatige intelligentie-engine Zijn:

-

- Identificeer en corrigeer typografische en spelfouten om de communicatie te verbeteren.

- Detecteert de intentie van het bericht, zelfs bij dubbelzinnige zinnen of meerdere betekenissen.

- Onderhoudt het kortetermijngeheugen om vragen met elkaar te verbinden en consistente antwoorden te garanderen.

- Het evalueert mogelijke antwoorden, kiest de beste en biedt suggesties voor duidelijkere gesprekken.

- Het past zich aan verschillende talen aan (Catalaans, Spaans, Engels), herkent straattaal en emoji's.

[3] El Verordening van het Europees Parlement en de Raad tot vaststelling van geharmoniseerde regels inzake kunstmatige intelligentie en tot wijziging van bepaalde wetgevingshandelingen van de Unie De wet (ook bekend als de RIA- of AI-wet) is op 2 augustus 2024 in werking getreden en is van toepassing vanaf 2 augustus 2026.