Transparència algorithmique : Des chatbots dotés d’une IA générative pour soutenir les citoyens d’AOC

Aperçu

Problème qui devrait être résolu d'ici fin 2023

-

- Besoin d’une assistance constante : Les utilisateurs d'AOC ont besoin d'une assistance continue 24h/7 et XNUMXj/XNUMX, mais une assistance en face-à-face ou par téléphone ne peut pas garantir cette disponibilité totale.

- Augmentation des demandes de renseignements et des incidents : L'utilisation croissante des services numériques et du portail transparència L'augmentation des demandes d'information et d'assistance liées à l'AOC a entraîné une hausse de 91 000 demandes annuelles (données de 2023) traitées par le Centre de services aux usagers (CSU). Afin de gérer efficacement cette augmentation et de maintenir l'engagement du CSU envers les citoyens, le moment est opportun pour envisager l'intégration de nouveaux outils permettant d'optimiser les ressources.

- Fracture numérique et difficultés de recherche : De nombreux utilisateurs, touchés par la fracture numérique et sociale, ont souvent du mal à savoir quoi chercher ou à interpréter correctement les résultats des moteurs de recherche traditionnels. Cela peut entraîner de la confusion et de la frustration dans votre expérience numérique, nécessitant un soutien plus personnalisé permettant un accès facile aux informations pertinentes.

Solution adoptée

-

- Développement de chatbot avec IA générative : Pour faciliter l'auto-résolution des requêtes de manière accessible et immédiate, des assistants conversationnels basés sur l'IA ont été créés. Ces chatbots permettent de répondre aux questions les plus courantes des utilisateurs en utilisant de grandes quantités de données et des algorithmes qui interprètent le langage naturel.

- Pourquoi opter pour des chatbots IA génératifs ? L'AOC a commencé à expérimenter les chatbots il y a près de dix ans, en les introduisant progressivement pour améliorer l'assistance aux utilisateurs. Dans un premier temps, des chatbots classiques ont été mis en place, tels que Paula (21/01/2021), qui apportait son aide pour l'identification avec VÀLid, et Rita (29/04/2021), qui aidait à obtenir, utiliser et renouveler le VÀLid.idCAT Le certificat et le chatbot du portail transparència (19/4/2023), consacré à la résolution des questions dans ce domaine. Malgré leur utilité, ces chatbots fonctionnent avec des règles et des flux structurés de questions et de réponses prédéfinies, ce qui nécessite une formation manuelle intensive, rend leur mise en œuvre complexe et coûteuse, et fournit des réponses avec un succès relatif.Voir le fichier de transparència Chatbots AOC conventionnels)

Forte de cette expérience, l’AOC s’engage désormais vers une nouvelle génération de chatbots basés sur les données et l’IA générative, qui nécessitent beaucoup moins de formation et peuvent apporter des réponses plus adaptées et contextualisées, améliorant ainsi l’expérience utilisateur. De plus, cette technologie permet de re-poser, c’est-à-dire de compléter la question initiale tout en gardant une cohérence avec la conversation précédente, alors que dans les chatbots classiques, chaque question est traitée comme si c’était la première.

A qui s'adresse-t-il ?

-

- Les citoyens qui utilisent les services de l'AOC, pour leur offrir un accompagnement accessible, rapide et 24h/XNUMX.

Cas d'utilisation

Les chatbots avec IA générative sont appliqués dans les services AOC suivants :

-

- VALIDE: assiste les citoyens pour les requêtes les plus fréquentes lors du processus d'identification sur la page VALid.

- idCat Mobile: aide à dissiper les doutes concernant l'obtention, l'utilisation et le renouvellement duidCat Téléphone.

- idCat certificate: offre un soutien pour l'obtention, l'utilisation et le renouvellement duidCat Certificat.

- e-NOTUM: résout les doutes et apporte un soutien dans la gestion des notifications électroniques.

- Representa: aide les citoyens et les entreprises à dissiper leurs doutes concernant representations et pouvoirs.

- e.FAIT:apporte un soutien dans l'élaboration et la gestion des factures électroniques.

Niveau de risque du système d'IA (selon les critères du règlement européen sur l'IA)

-

- Risque limité. Ne présente pas de risque significatif de porter atteinte à la santé, à la sécurité ou aux droits fondamentaux des personnes, et n'influence pas substantiellement le résultat de la prise de décision.

Statut

-

- Mis en œuvre et utilisé depuis mai 2024, avec une moyenne de 11.575 XNUMX utilisateurs mensuels.

Accord de niveau de service

-

- Disponible 24h/7 et 99,8j/XNUMX avec un niveau de disponibilité de XNUMX%.

Principaux avantages du service

Pour les citoyens :

-

- Accès aux informations 24h/7 et XNUMXj/XNUMX : Les citoyens peuvent obtenir de l'aide à tout moment, sans restriction de temps, ce qui facilite la résolution des doutes lorsqu'ils en ont besoin.

- Réponse immédiate : Les chatbots offrent des réponses instantanées, évitant les temps d'attente des canaux traditionnels tels que l'assistance en face à face ou par téléphone.

- Auto-résolution des requêtes : Les utilisateurs peuvent résoudre leurs problèmes de manière autonome, réduisant ainsi leur dépendance à l'égard d'une assistance directe et améliorant l'expérience.

- Expérience utilisateur améliorée : Les chatbots dotés d'IA générative permettent une interaction plus naturelle et plus étroite, facilitant une « conversation » authentique avec l'utilisateur. Ces chatbots peuvent s'adapter à la manière de s'exprimer de chacun, lui permettant de préciser ou d'affiner sa question avec ses propres mots.

Pour l'administratif :

-

- Optimisation des ressources: Les chatbots gèrent les requêtes répétitives, libérant ainsi le personnel pour des tâches plus complexes, ce qui améliore l'efficacité du temps et des ressources.

- Réduction des coûtsChaque requête traitée par le chatbot coûte bien moins cher que l'intervention humaine. Une estimation préliminaire, basée sur des données de 2025, situe les économies à environ [montant manquant]. 96 % (coût moyen approximatif de 15€ pour consultation à laquelle a assisté le personnel de CAU contre. 0,60€ via chatbot).

Ce chiffre est indicatif et sera confirmé lorsqu'une analyse économique plus détaillée aura été réalisée. - Efficacité accrue: Les chatbots traitent plusieurs requêtes à la fois, évitant ainsi les goulots d'étranglement et améliorant la réactivité.

- Moins d'effort de formation: Les chatbots d'IA générative nécessitent moins de configuration et de formation initiales, à partir d'un modèle général pré-entraîné qui s'ajuste avec un minimum de modifications. Le processus d'ajustement consiste à revoir et corriger les réponses incorrectes détectées, plutôt que de travailler de manière exhaustive sur la classification et la structuration des réponses pour chaque intention [1].

- Amélioration continue des services: L'analyse des conversations permet d'identifier des modèles, d'améliorer les domaines clés et d'adapter les services aux besoins des utilisateurs.

Coordonnées

Administration ouverte de Catalogne

Contacter l'équipe pour toute demande de renseignements

Sous-direction de la stratégie et de l'innovation

E-mail de l'équipe

innovacio@aoc.cat

ONE MILLION BOT, SL

E-mail du fournisseur

info@1millionbot.com

Informations plus détaillées sur le service

Familiarisez-vous avec les données et informations utilisées par le système, la logique de fonctionnement des algorithmes et sa gouvernance.

Ensembles de données

La base de connaissances des chatbots repose sur trois sources principales :

-

- Questions fréquemment posées (FAQ) : les chatbots sont initialement formés avec une base de données de questions fréquemment posées disponible sur le portail d'assistance. Ces FAQ rassemblent les questions les plus courantes des citoyens et sont mises à jour avec les informations les plus récentes sur le service.

- Billets récurrents : Les chatbots apprennent également de l'analyse des tickets d'assistance historiques qui contiennent des informations sur les questions, les doutes et les incidents des utilisateurs et sur la manière dont ils ont été résolus.

- Commentaires continus : Le système de chatbot présente une forme d’apprentissage constant où chaque tentative générative comporte une série de phrases d’entraînement nourries par les conversations des utilisateurs. Si une personne pose une nouvelle question, le chatbot essaiera de rechercher des similitudes dans sa base de phrases d’entraînement existante. Si le chatbot génère une réponse incorrecte à cette question, pendant la période de révision de la conversation, la phrase sera incluse dans la tentative correspondante et l'IA générera des variantes de celles-ci pour avoir une base de connaissances plus étendue.

Autres données d'entrée :

-

- Données utilisateur : Aucune donnée personnelle des utilisateurs n'est utilisée pour former le modèle.

Considérations sur le traitement et conservation des données

-

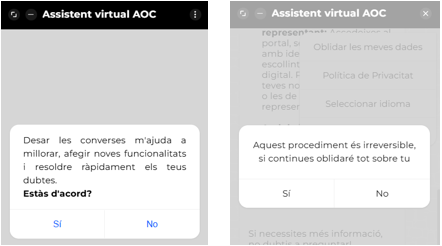

- Le système d'IA enregistre dans un fichier les questions posées et les réponses apportées lors de la session de chat. Il génère également des rapports avec des données d'utilisation, des conversations et des statistiques en ligne à des fins d'analyse et d'amélioration du service.

- Les conversations sont conservées 3 mois maximum, après quoi elles sont automatiquement supprimées.

- Les rapports d'utilisation, comprenant des paramètres tels que les taux d'utilisation et de réponse, sont conservés indéfiniment pour garantir la traçabilité et l'évaluation continue du service.

Traitement de l'information

La logique opérationnelle du traitement automatique des données et le raisonnement effectué par le système reposent sur le modèle et la méthodologie suivants :

Processus d'interaction utilisateur-chatbot

Le processus d'interaction utilisateur-chatbot s'effectue via une interface numérique accessible depuis des appareils tels que le Web, le mobile ou la tablette. L'utilisateur saisit une question au format texte (« invite ») qui décrit les informations qu'il souhaite obtenir. Le chatbot traite ces informations et génère une réponse textuelle pour fournir les informations demandées.

Architecture des services

Le service utilise un moteur d'intelligence artificielle générative [2] qui traite le langage naturel.

-

- Le moteur d'IA utilisé par le chatbot AOC est GPT-4o, de la société OpenAI.

- Une instance Azure OpenAI située en Europe est utilisée.

- Le moteur fonctionne sur la base d'un grand modèle de langage (Large Language Model, LLM), composé de réseaux de neurones profonds entraînés avec d'énormes ensembles de données extraits essentiellement d'Internet (pages Web, blogs, réseaux sociaux, articles scientifiques, livres). , etc.)

Le service a été adapté par 1MillionBot, qui a été chargé de :

-

- Concevez les instructions qui permettent au modèle d'IA de guider et de suivre les instructions.

- Préparer les ensembles de données, la collecte et le nettoyage des données qui serviront de référence au système Retrieval Augmented Generation (RAG)

- Incorporation d'ensembles de données dans le système RAG de 1MillionBot, capable d'améliorer la qualité des réponses en utilisant des contextes spécifiques.

- Testez les cas et validez la capacité du système à gérer les erreurs et les requêtes complexes.

- Optimisation du modèle basée sur les interactions des utilisateurs.

L'ensemble de l'infrastructure du service est hébergé dans le cloud de Plateforme Google Cloud (GCP), plus précisément dans le centre de données Google Cloud en Belgique, au sein de l'Espace économique européen (EEE). Cet emplacement garantit le respect des réglementations européennes en matière de confidentialité et de sécurité.

Le chatbot dispose d'un système pour recueillir l'avis des utilisateurs et pouvoir évaluer la satisfaction de la conversation globale.

Principales caractéristiques de l'architecture :

-

- Un hébergement sûr et certifié:

-

- Les installations GCP sont conformes aux normes de sécurité ISO 27001 i SOC2/3, garantissant une infrastructure robuste et fiable.

- Toutes les infrastructures du fournisseur, 1MillionBot, y compris le webchat, la plateforme Millie (frontend) et la logique et les données (backend), sont hébergés dans cet environnement.

-

- Isolement par cas d'utilisation:

-

- Chaque cas d'utilisation du service est isolé dans un environnement de réseau et de développement spécifique, évitant ainsi les interférences entre les applications et maximisant la sécurité.

-

- Stockage protégé:

-

- Les questions et réponses des conversations sont stockées dans des bases de données hébergées sur des machines virtuelles Google Cloud, qui sont protégées par des pare-feu avancés et des mécanismes d'isolation.

- L’accès à ces données se fait exclusivement via le backend, garantissant un contrôle strict.

-

- Protection contre les attaques:

-

- Le système intègre plusieurs niveaux de sécurité, tels que :

-

- Limiteurs de requêtes pour éviter les surcharges.

- Des validations strictes des données et de l'accès.

- Pare-feux spécialisés pour protéger les infrastructures.

-

- Le système intègre plusieurs niveaux de sécurité, tels que :

-

- Un hébergement sûr et certifié:

Cette architecture assure la robustesse, la sécurité et l'adaptabilité nécessaires pour offrir un service de qualité aux utilisateurs.

Performances de l'algorithme

Taux de réussite de 91,33%. Ce tarif est révisé mensuellement (dernière révision : 15/04/2025)

Supervision humaine

Le système algorithmique du chatbot agit directement, mais il est sous surveillance ex post du personnel responsable de la décision finale, particulièrement intensifié dans la période initiale de fonctionnement pour compenser les biais de l'algorithme et réduire les mauvaises réponses. Les réponses du chatbot sont fixes et ne peuvent pas être modifiées.

La supervision humaine des chatbots garantit la qualité et l’exactitude des réponses à travers un processus rigoureux et régulier :

-

- Bilans hebdomadaires: Les experts examinent les journaux de discussion pour identifier les réponses incorrectes. Pour chaque erreur détectée, la réponse idéale est notée et les phrases utilisateur avec la mauvaise réponse sont reclassées, en les attribuant à la tentative générative la plus appropriée.

- Analyse mensuelle : 150 conversations sélectionnées au hasard sont évaluées, ainsi que celles déjà identifiées comme erronées, pour détecter les modèles d'erreur et corriger les réponses inappropriées.

- Gestion des tentatives : Lorsque les erreurs ne peuvent pas être corrigées par une simple reclassification des phrases, les experts ajustent les invites des tentatives existantes ou créent de nouvelles tentatives.

Ce processus combine la méthodologie traditionnelle des chatbots avec la flexibilité de l'IA générative, garantissant une gestion agile et un service fiable, aligné sur les besoins des utilisateurs.

Conformité réglementaire du système

Le système ne traite pas de données personnelles. Le système est néanmoins conforme aux réglementations en vigueur en matière de protection et de sécurité des données. En particulier:

-

- Les principes du Règlement Général sur la Protection des Données (RGPD) s’appliquent :

- Principe de minimisation des données : seules les données nécessaires à la réalisation de la finalité du système sont collectées.

-

- Principe de limitation des finalités : les données collectées ne sont utilisées qu'aux fins communiquées à la personne concernée.eressada.

- Les principes du Règlement Général sur la Protection des Données (RGPD) s’appliquent :

-

- D'un point de vue technique, la solution est conforme aux exigences établies par le Système National de Sécurité (ENS) pour les systèmes de BAS niveau.

✨Application volontaire de Règlement sur l’intelligence artificielle de l’Union européenne (règlement IA) [3]

Le système est conforme aux exigences du règlement IA requis en cas de systèmes d'IA à risque limité i modèles d'IA génératifs sans risque systémique. C'est pourquoi :

-

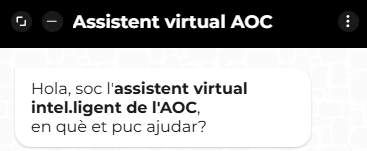

- Les utilisateurs sont informés dès le départ qu’ils interagissent avec une IA. Pour cette raison, le service est présenté comme « assistant virtuel AOC » et non avec un nom personnel.

-

- En tant qu'IA générative, Les chatbots AOC répondent également aux exigences suivantes :

-

- Il est révélé que le contenu est généré par l'IA.

- Un résumé des données de formation est publié.

- Les informations sur le modèle d'IA sont fournies dans un langage clair et accessible.

Les deux derniers points sont couverts par cette fiche technique. transparència algorithmique.

-

- Ces chatbots ne sont pas soumis aux exigences de l’IA générative à risque systémique. Cela signifie qu'il n'est pas nécessaire de passer des évaluations de modèles ou des tests contradictoires, ni de rendre compte de l'efficacité énergétique.

- En tant qu'IA générative, Les chatbots AOC répondent également aux exigences suivantes :

C'est un Action administrative automatisée (AAA) ? Non.

Dans ce cas, l'AOC n'est pas soumise à l'obligation légale de publier sur son site Internet l'AAA lié au service, accompagné d'un dossier technique (Voir l'article 11, lettre i, du décret royal 203/2021, qui approuve le règlement sur le performance et fonctionnement du secteur public par voie électronique, qui met en œuvre la loi 40/2015 sur le régime juridique du secteur public)

Gestion des risques

Connaître le des risques plus probables par rapport à la principes et droits fondamentaux qui doivent être protégés, ainsi que les mesures appliquées dans chaque cas pour les atténuer ou les minimiser.

A. Égalité et non-discrimination

-

- Risques identifiés : biais dans les résultats, risque d’exclusion et de discrimination.

-

- Le modèle LLM du moteur GPT-4o, qui constitue la base des chatbots AOC, est pré-entraîné avec de grands volumes de données provenant d'Internet. Ces données comprennent une grande variété d’informations et peuvent contenir des biais liés au sexe, à l’origine ethnique, à la langue, entre autres. En conséquence, le système peut reproduire les modèles discriminants présents dans les données d’entraînement. De plus, la complexité des réseaux de neurones rend difficile l’identification et la prévention de ces biais.

- En revanche, le catalan ne fait pas partie des principales langues utilisées dans la formation des modèles. Cela peut entraîner des réponses avec une utilisation prédominante des formes masculines et une moindre diversité linguistique, affectant le caractère inclusif et la richesse des interactions dans cette langue.

-

- Mesures appliquées

-

- Données d'entraînement representativesLes données utilisées pour l'entraînement final et le réglage du chatbot ont été soigneusement sélectionnées afin d'inclure divers groupes de population et d'éviter les biais explicites, dans le but de garantir que les réponses soient les plus pertinentes possible. representapossible et juste.

- Égalité d’accès linguistique: Le service peut être utilisé en catalan et en espagnol, avec la possibilité de choisir la langue au début de la conversation ou de la changer en cours d'utilisation. Cela permet à tous les utilisateurs d'interagir avec le système dans la langue de leur choix.

-

- Actuellement, le chatbot demande à l'utilisateur dans quelle langue il préfère être servi, car cela améliore la précision des réponses. Cependant, des tests sont en cours pour évaluer ses performances sans qu'il soit nécessaire de solliciter la langue.

-

- Interprétation tolérante du langage: Le système est conçu pour comprendre le langage naturel, même s'il y a des erreurs d'orthographe ou de linguistique, garantissant que les utilisateurs ne soient pas pénalisés pour de petites erreurs dans leurs requêtes.

- Inclusion et diversité dans la conceptionUn travail a été réalisé sur une interface de chatbot facile à utiliser pour tous, quel que soit leur niveau de compétences numériques, afin de garantir l'accès au service sans barrières pour tous.eres technologique.

-

- Risques identifiés : biais dans les résultats, risque d’exclusion et de discrimination.

B. Protection des données, vie privée et liberté de choix

-

- Risques identifiés : menace possible pour la vie privée, utilisation abusive des données personnelles par des tiers et perte de la liberté de choix.

-

- Le service ne demande jamais d’informations personnellement identifiables. Cependant, le service comporte un risque lié au traitement des données personnelles si l'utilisateur saisit des données personnelles inutiles.

-

- Mesures appliquées

-

- Pour protéger les données et la confidentialité :

-

- Le fournisseur (1MillionBot) a signé un ordre de traitement avec la localisation des données au sein de l'Union européenne.

- Le Responsable du Traitement (AOC) garantit les droits ARCO (Accès, Rectification, Annulation et Opposition) des données traitées.

- Le consentement et les cookies sont gérés.

- Les journaux de conversations sont régulièrement examinés par des experts qui suppriment toutes les données personnelles non détectées par le système.

- Dans la prochaine version, une fonctionnalité sera implémentée qui supprimera automatiquement tout numéro de sécurité sociale ou e-mail saisi dans le chat, et l'utilisateur pourra demander que sa conversation soit supprimée du système.

- L'utilisateur est informé que la conversation sera enregistrée. Si vous n'êtes pas d'accord, vous ne pouvez pas continuer.

- L'utilisateur peut supprimer les conversations.

-

- Pour garantir la liberté de choix:

-

- Nous proposons des alternatives pour aider les citoyens sans recourir à des algorithmes d’IA, comme l’assistance téléphonique et par courrier électronique. Si l'utilisateur demande spécifiquement de « contacter l'assistance », « parler à un agent », « Je veux plus d'assistance » ou similaire, le bot redirige automatiquement vers les pages de contact de l'assistance AOC. De plus, le chatbot est situé au sein des portails d'assistance AOC eux-mêmes, où vous pouvez également accéder directement à l'option « Contacter l'assistance » depuis le pied de page.

-

- Pour protéger les données et la confidentialité :

-

- Risques identifiés : menace possible pour la vie privée, utilisation abusive des données personnelles par des tiers et perte de la liberté de choix.

C. Sécurité et robustesse

-

- Risques identifiés : diffusion d'informations incorrectes, erreurs et incohérences dans les réponses, indisponibilité du service et accès non autorisé aux données.

-

- Les modèles basés sur les réseaux de neurones et les calculs probabilistes rendent difficile l'interprétation de la manière dont le résultat final est atteint, ce qui limite le contrôle sur les réponses générées. De plus, la nature de l’IA générative peut parfois amener le système à puiser des informations au-delà de sa base de connaissances spécifique, y compris des sources ou des données externes non vérifiées, ce qui peut entraîner des réponses hors contexte ou sur des sujets qui n’appartiennent pas à leur domaine. .

- Pour atténuer ces risques, le moteur d'IA doit être installé dans un environnement contrôlé et protégé, avec une configuration et une sécurité strictes pour garantir la protection et l'intégrité du service.

-

- Mesures appliquées

-

- Le système a été installé dans un environnement fermé et sécurisé, basé sur une architecture certifiée (voir les principales caractéristiques de l'architecture). Cette configuration garantit :

- Robustesse et fiabilité, garantissant le bon fonctionnement du système.

- Sécurité et confidentialité des données gérées.

-

- Adaptabilité, pour proposer des réponses de qualité et adaptées aux besoins des utilisateurs.

- Analyse des risques de sécurité:L'AOC a réalisé une évaluation de sécurité en suivant les directives de l'Agence catalane de cybersécurité et du Schéma national de sécurité (ENS). Le système a été classé avec un niveau de sécurité FAIBLE et, conformément à cette catégorisation, des mesures spécifiques ont été mises en œuvre pour atténuer les risques identifiés. Plus précisément, pour assurer la disponibilité et bon fonctionnement du système :

- Des accords de niveau de service (SLA) ont été établis avec le fournisseur, qui doivent être respectés et révisés périodiquement, pour garantir la capacité, la disponibilité et la gestion des incidents du système.

-

- Des rapports de conformité ANS bimensuels sont effectués pour garantir que le service respecte les normes convenues.

- Le système a été installé dans un environnement fermé et sécurisé, basé sur une architecture certifiée (voir les principales caractéristiques de l'architecture). Cette configuration garantit :

-

- Pour garantir le droit à un des informations véridiques et adéquates: des protocoles sont appliqués pour examiner le système, minimiser les erreurs et les incohérences et améliorer la qualité des réponses. De plus, pour garantir des réponses dans le périmètre de compétence du chatbot :

-

- Des filtres par mots-clés et par thèmes ont été mis en place (ex : Attestation d'inscription, Paiement d'une amende, Pré-inscription à l'école, etc.). Ces filtres génèrent des « tentatives hors catalogue », avec lesquelles le chatbot informe qu'il ne dispose pas d'informations sur le sujet et recommande de contacter l'administration compétente.

- Le modèle est formé exclusivement sur les données du domaine AOC, garantissant autant que possible que les informations sont pertinentes et adaptées à leur objectif.

-

- Pour garantir le droit à un des informations véridiques et adéquates: des protocoles sont appliqués pour examiner le système, minimiser les erreurs et les incohérences et améliorer la qualité des réponses. De plus, pour garantir des réponses dans le périmètre de compétence du chatbot :

-

- Risques identifiés : diffusion d'informations incorrectes, erreurs et incohérences dans les réponses, indisponibilité du service et accès non autorisé aux données.

D. Transparència et explicabilité

-

- Risques identifiés : méfiance, mauvaise interprétation des résultats par les utilisateurs (incapacité à comprendre le résultat), confusion en pensant qu'il s'agit d'une interaction avec un humain, difficultés à déposer des plaintes ou des demandes de renseignements sur les résultats obtenus

- Mesures appliquées

-

- Identification claire en tant qu'IA : Dès le départ, le service est présenté comme un « assistant virtuel » pour éviter toute confusion sur la nature de l’interaction.

-

- Consentement de l'utilisateur : Les utilisateurs sont informés que la conversation sera enregistrée, afin qu'ils puissent décider s'ils souhaitent continuer.

- Fichier de transparència algorithmique : Il est publié sur le site Internet de l'AOC, avec des informations sur :

-

- Problème à résoudre

- Avec le système d'IA mis en œuvre

- Public cible

- Données utilisées pour entraîner le système d'IA

- Identité et coordonnées du fournisseur

- Organisme responsable et adresse de contact pour les plaintes, demandes de renseignements et suggestions

-

- Accès facile à la fiche : La feuille de transparència Elle peut être consultée depuis la page d'accueil du service.

-

E. Conservation des comptes et auditabilité

-

- Risques identifiés: Limites dans la traçabilité des résultats, manque de vérification et de revue périodique, difficultés dans l'interprétation du modèle même par des spécialistes, absence de responsabilité assignée.

-

- Les risques associés à la responsabilité et à l’auditabilité des chatbots génératifs d’IA peuvent mettre en péril la fiabilité du système s’il n’existe aucun moyen de retracer avec précision le processus de génération de réponse, de vérifier régulièrement la qualité et de garantir que le fonctionnement est compréhensible même par des spécialistes. Ces facteurs rendent difficile une supervision adéquate du service et rendent difficile l'attribution de responsabilités en cas d'erreurs ou de décisions injustes, qui peuvent affecter la confiance dans le service public.

-

- Mesures appliquées

-

- Pour assurer la responsabilité du système d’IA et de ses résultats :

-

- Suivi de la qualité et de l'impact: Des rapports bihebdomadaires sont réalisés avec des indicateurs de qualité et d'impact pour évaluer si le service répond aux objectifs fixés.

-

- Garantir la responsabilité du système et de ses résultats :

- Il est indiqué qui est responsable du service (AOC) et la procédure à suivre pour déposer une plainte en cas d'impacts négatifs.

- Pour garantir l’auditabilité :

-

- L'AOC se réserve le droit de mener des audits supplémentaires pour examiner les indicateurs de qualité et les accords de niveau de service (SLA) à tout moment, garantissant ainsi une surveillance continue de la fiabilité du système.

-

- Pour assurer la responsabilité du système d’IA et de ses résultats :

-

- Risques identifiés: Limites dans la traçabilité des résultats, manque de vérification et de revue périodique, difficultés dans l'interprétation du modèle même par des spécialistes, absence de responsabilité assignée.

F. Développement durable et solidarité

-

- Risques identifiés:impact environnemental négatif, inégalités d’accès à cette technologie en raison de son coût élevé.

-

- L’utilisation de chatbots avec une IA générative pose des défis importants en termes de durabilité et d’équité. D’une part, son impact environnemental est élevé, car il nécessite d’importantes ressources de calcul pour le traitement et le stockage des données, ce qui implique une consommation d’énergie et des émissions de CO₂ élevées. En revanche, son coût de mise en œuvre et de maintenance est important, ce qui peut limiter l’accès à cette technologie aux organisations disposant de plus de ressources.

-

- Mesures appliquées

-

- Réglage et optimisation de la formation des chatbots pour atteindre une efficacité maximale. Des études indiquent qu'une requête ChatGPT peut être équivalente à dix recherches Google ; par conséquent, si cela se confirme, le coût énergétique élevé de l’IA générative pourrait être compensé par sa plus grande efficacité par rapport aux méthodes moins coûteuses.

- Promotion de transparència à propos des coûts d'utilisation contribuer à une utilisation plus responsable de cette technologie.

-

- Promouvoir la transférabilité:L'AOC travaille pour offrir le chatbot comme un service « clé en main » aux administrations locales catalanes, facilitant l'accès à cette technologie de manière équitable. Cette stratégie de reproductibilité permettra l’adoption d’une IA générative avancée sans nécessiter de gros investissements.

-

- Risques identifiés:impact environnemental négatif, inégalités d’accès à cette technologie en raison de son coût élevé.

En savoir plus

-

- Fichier du Registre des IA et autres algorithmes de la Generalitat : Chatbots AOC

- Fiche d'innovation AOC : Chatbots dotés de l'IA générative d'AOC : une attention immédiate, efficace et accessible

- Article "IA générative et ChatGPT. Impact sur l'apprentissage universitaire". Par Climent Nadeu Camprubí. Département de théorie du signal et des communications (TSC). Centres de recherche TALP et IDEAI. Université Polytechnique de Catalogne (UPC).

[1] Un intention fait référence à l'intention ou au but que l'utilisateur a lorsqu'il pose une question ou adresse une requête au chatbot. Les tentatives aident à identifier ce que la personne souhaite réaliser, comme obtenir des informations spécifiques, résoudre un problème ou terminer un processus. Dans les chatbots traditionnels, les tentatives doivent être prédéfinies et entraînées manuellement afin que le chatbot puisse les reconnaître et fournir la réponse appropriée. En revanche, les chatbots dotés d’IA générative peuvent identifier et interpréter les tentatives de manière plus flexible en générant des réponses en temps réel à partir du contexte de la conversation, sans avoir besoin d’une classification exhaustive des tentatives au préalable. Cela rend l’interaction plus naturelle et adaptée aux besoins de l’utilisateur.

[2] Certaines des principales capacités du moteur d'intelligence artificielle générative sont:

-

- Identifier et corriger les erreurs typographiques et orthographiques pour améliorer la communication.

- Détecte l'intention du message, même avec des phrases ambiguës ou des significations multiples.

- Maintient la mémoire à court terme pour relier les questions et garantir des réponses cohérentes.

- Il évalue les réponses possibles, choisit la meilleure et propose des suggestions pour des conversations plus claires.

- Il s'adapte à plusieurs langues (catalan, espagnol, anglais), reconnaît l'argot et les emojis.

[3] El Règlement du Parlement européen et du Conseil établissant des règles harmonisées en matière d'intelligence artificielle et modifiant certains actes législatifs de l'Union (également connue sous le nom de RIA ou AI Act) est entrée en vigueur le 2 août 2024 et s'appliquera à partir du 2 août 2026.